生成AIが「もっともらしいが事実ではない情報」を生成する現象――ハルシネーション(Hallucination)は、企業のAI活用における最大の課題の1つです。詳しくは「企業のAI利用ガイドライン策定ガイド」で解説しています。

弁護士がChatGPTを使って作成した準備書面に実在しない判例が含まれていたニューヨークの事例(2023年6月)は、ハルシネーションのリスクを世界に知らしめました。ビジネスシーンでも、顧客への誤った製品情報の提供、存在しない統計データの引用、架空の企業事例の記載など、放置すれば信用毀損につながるリスクがあります。AI活用完全ガイドで、AI活用の全体像を把握できます。

関連する記事の一覧はAIガバナンス・倫理ガイドをご覧ください。

この記事でわかること

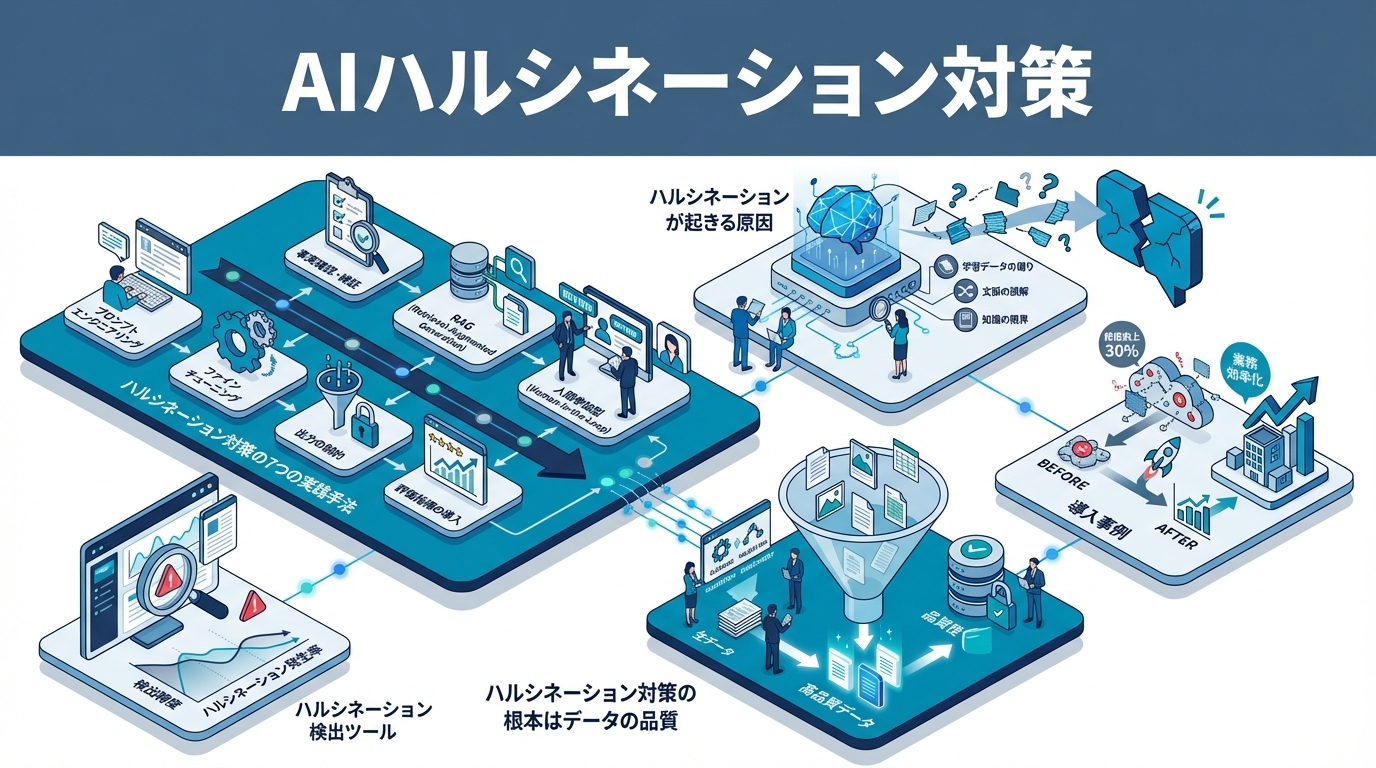

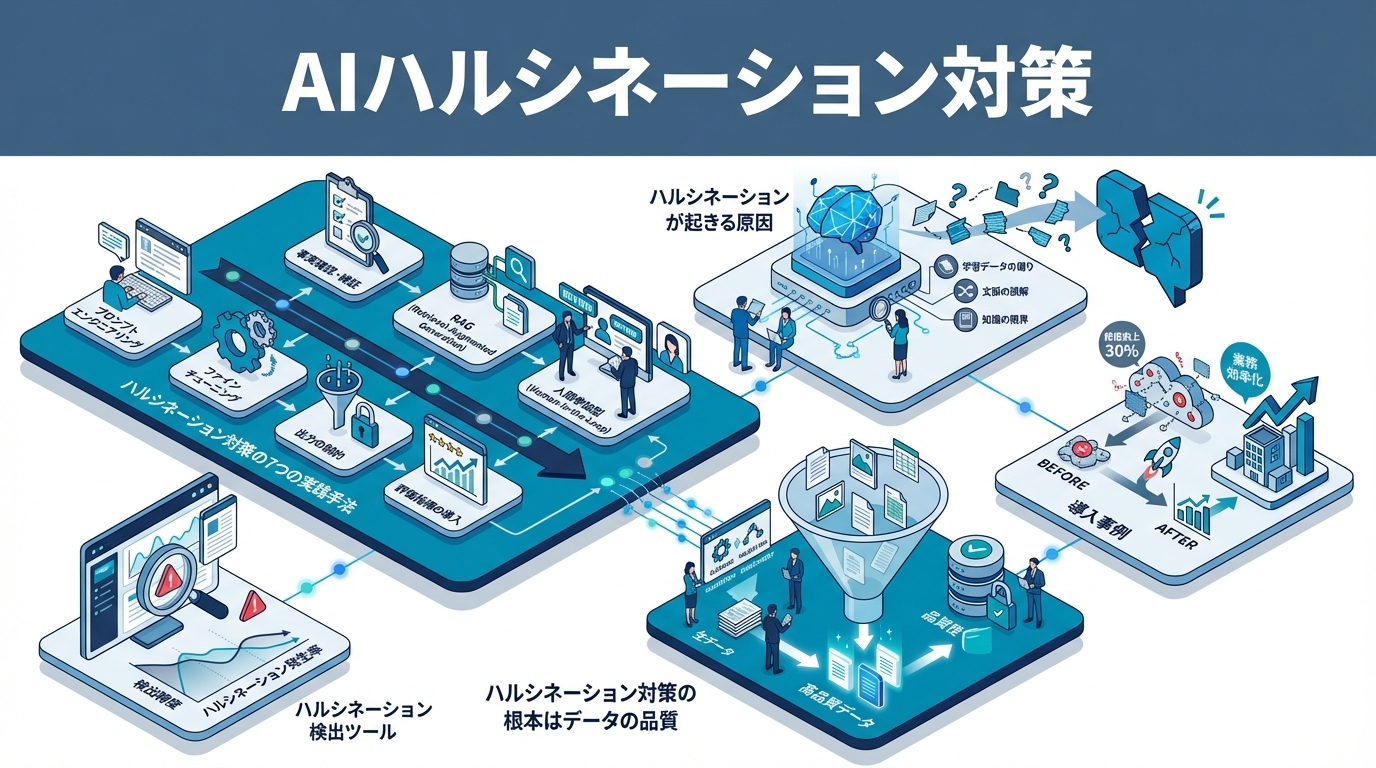

- ハルシネーションが起きる原因 — 生成AIが「もっともらしいが事実ではない情報」を生成する現象――ハルシネーション(Hallucination)は。

- ハルシネーション対策の7つの実践手法 — 社内のドキュメントやナレッジベースから関連情報を検索し、LLMの入力に追加する仕組みです。

- ハルシネーション検出ツール — Vectara HHEM・Galileo・Guardrails AI・DeepEvalなど、RAG品質管理や運用監視に使える主要ツールを紹介します。

- 導入事例 — みずほは、社内のAI利用において「TripleCheck」体制を導入。

AIハルシネーション対策について理解を深めたい方に、特に参考になる内容です。

ハルシネーションが起きる原因

| 原因 |

説明 |

| 学習データの限界 |

LLMは確率的にトークンを生成するため、学習データに含まれない情報は「それらしく」でっち上げる |

| 情報の時間的ギャップ |

学習データのカットオフ以降の情報を正確に回答できない |

| 指示の曖昧さ |

プロンプトが曖昧だと、AIが推測で情報を補完する |

| 自信過剰な応答 |

LLMは「わからない」と答えるより、何らかの回答を生成するよう学習されている |

| 長文生成時の逸脱 |

長い文章を生成する途中で、文脈から逸脱した情報を挿入する |

ハルシネーション対策の7つの実践手法

対策1:RAG(検索拡張生成)の導入

社内のドキュメントやナレッジベースから関連情報を検索し、LLMの入力に追加する仕組みです。LLMが「知らないこと」を推測で回答する代わりに、正確な情報源を参照して回答できるようになります。詳しくは「EU AI法が日本企業に与える影響」で解説しています。

RAGの効果は検索精度に依存するため、ドキュメントのチャンキング、エンベディングモデルの選定、ハイブリッド検索の実装が重要です。

対策2:出典の明示を要求

プロンプトに「回答の根拠となる情報源を明示してください。情報源が不明な場合はその旨を伝えてください」と追加します。出典が明示されれば、人間が検証可能になります。

対策3:確信度の表明を要求

「回答の確信度を1〜5段階で示してください。確信度が3以下の項目は明示してください」とプロンプトに追加します。AIの自己評価は完璧ではありませんが、不確実な部分を特定するヒントになります。

対策4:ファクトチェックプロセスの義務化

AIの出力に含まれる事実(数値、企業名、製品名、法律名、統計データ)を人間が必ず検証するプロセスを組織的に導入します。

| 出力の種類 |

ファクトチェックレベル |

| 社外向け文書(提案書、ブログ、広告) |

全項目の事実確認必須 |

| 社内レポート |

数値・固有名詞の確認 |

| アイデア出し・ブレスト |

チェック不要 |

対策5:LLMの使い分け

ハルシネーションの発生率はモデルによって異なります。高精度が求められるタスクではAnthropicのClaudeやGPT-4oなど最新の大規模モデルを使い、コスト効率重視のタスクでは小型モデルを使う――タスクの重要度に応じた使い分けが有効です。

対策6:複数AIの検証(クロスチェック)

重要な回答は、複数のAIモデル(GPT-4o、Claude、Gemini)に同じ質問を投げ、回答が一致するかを確認します。回答が大きく異なる場合は、ハルシネーションの疑いがあるためより慎重な確認が必要です。

対策7:ガードレールの実装

AIの出力に対してルールベースのフィルタリングを適用します。

- 特定の主張には必ず数値の裏付けを要求

- 固有名詞(企業名、人名、法律名)を外部データベースで自動照合

- 禁止表現(断定的な投資アドバイス等)の自動検出

ハルシネーション検出ツール

| ツール |

特徴 |

用途 |

| Vectara HHEM |

ハルシネーション評価モデル。RAG回答の整合性を検証 |

RAG品質管理 |

| Galileo |

LLMの出力品質モニタリング。本番環境での監視 |

運用監視 |

| Guardrails AI |

出力のバリデーション。構造化ルールで品質担保 |

ガードレール実装 |

| DeepEval |

LLMの回答精度をテスト。CI/CDに組み込み可能 |

テスト自動化 |

導入事例

みずほフィナンシャルグループ

みずほは、社内のAI利用において「Triple Check」体制を導入。AIの出力→担当者チェック→上長承認の3段階プロセスで、ハルシネーションによる誤情報の外部流出を防止しています。特にIR関連資料や顧客向け文書では、AI出力の全数確認を義務化しています。

富士フイルムビジネスイノベーション

富士フイルムBIは、社内ナレッジ検索AIにRAGを導入し、出典表示を必須化。回答とともに参照元ドキュメントのリンクを表示し、ユーザーが容易に原典を確認できる仕組みを構築しています。

ハルシネーション対策の根本はデータの品質

CRMを中心とした業務データがAIの情報源として活用される場面が増えるほど、データの正確性・最新性が重要になります。CRMに蓄積された情報が正確であれば、RAGを通じてAIが参照するデータの信頼性も担保され、結果としてハルシネーションのリスクが低減します。ハルシネーション対策は、技術的な仕組みだけでなく、データガバナンスの整備から始まります。また、AIの出力を業務プロセスに組み込む際は責任あるAIの実装ガイドも参照してください。Claude Codeによる経営データの可視化でも、同様のアプローチが活用されています。

AI CRMで実現するAIハルシネーション対策

AIハルシネーション対策を実務に落とし込むには、CRMツールの活用が不可欠です。詳しくは「生成AIとCRMの連携活用ガイド|ChatGPT・Claude等のAIでCRM業務を効率化する方法」で解説しています。

あわせて読みたい

関連する記事:

まとめ

ハルシネーションはLLMが確率的にトークンを生成する構造上の限界から発生する。RAG導入が最も効果的な対策。検索精度はチャンキング・エンベディングモデル・ハイブリッド検索に依存。

実践にあたっては、以下のポイントを押さえておくことが大切です。

- 社外向け文書は全項目の事実確認必須、社内レポートは数値・固有名詞の確認が基準

- 重要な回答は複数AIモデル(GPT-4o・Claude・Gemini)のクロスチェックが有効

- データの正確性・最新性がハルシネーション対策の根本であり、CRMのデータガバナンス整備から始める

よくある質問(FAQ)

Q1. ハルシネーションを完全にゼロにすることはできますか?

現時点の技術では完全にゼロにすることは困難です。ただし、RAGの導入(出典付き回答)、プロンプトの制約条件設定(「情報がない場合は回答しない」)、人間によるファクトチェック体制の3つを組み合わせることで、実務上許容できるレベルまで抑制可能です。「ゼロリスク」を目指すのではなく、リスクを管理可能な水準にコントロールする設計が現実的です。

Q2. どのような業務でハルシネーションのリスクが特に高いですか?

法的助言、医療情報、財務データに基づく意思決定の3領域はリスクが特に高いです。これらの領域ではAIの出力を「参考情報」と明確に位置づけ、最終判断は必ず専門家が行う体制にしてください。

Q3. CRMデータを使ったAI回答でもハルシネーションは発生しますか?

発生する可能性はあります。CRMデータが不正確・古い・不完全な場合、AIはそのデータをもとに誤った回答を生成します。データの鮮度と正確性の維持が、AI活用の前提条件です。定期的なデータクレンジングの仕組み化が重要です。

AI活用やCRM連携について詳しく知りたい方は、150社以上のCRM導入支援実績を持つ株式会社StartLinkにお気軽にご相談ください。