StartLinkでは、HubSpot CRMのAI機能(Breeze)を活用する際のResponsible AI設計を支援しています。「AI活用のリスク評価を行いたい」「AI倫理ポリシーを策定したい

StartLinkでは、HubSpot CRMのAI機能(Breeze)を活用する際のResponsible AI設計を支援しています。「AI活用のリスク評価を行いたい」「AI倫理ポリシーを策定したい

ブログ目次

HubSpot導入、AI活用、CRM整備、業務効率化までをまとめて支援しています。記事で気になったテーマを、そのまま相談ベースで整理できます。

AIの採用選考ツールが特定の性別を不利に判定していた、AIによる与信審査が特定の人種に対して低いスコアを付けていた――これらは実際に発生したAIバイアスの事例です。Amazon社は2018年、AIを活用した採用選考ツールが女性応募者を不利に評価していたことが判明し、ツールの使用を中止しました。詳しくは「ファインチューニングの企業活用ガイド」で解説しています。

AI技術が業務の意思決定に深く組み込まれるほど、AIの「判断の公正性」が企業の信頼性そのものに直結します。AI音声認識や画像認識など、ビジネスデータを扱うAI技術においても、この公正性の担保は重要な課題です。バイアスのあるAIを放置すれば、法的リスク、レピュテーションリスク、そして何より顧客・従業員への実害が発生します。

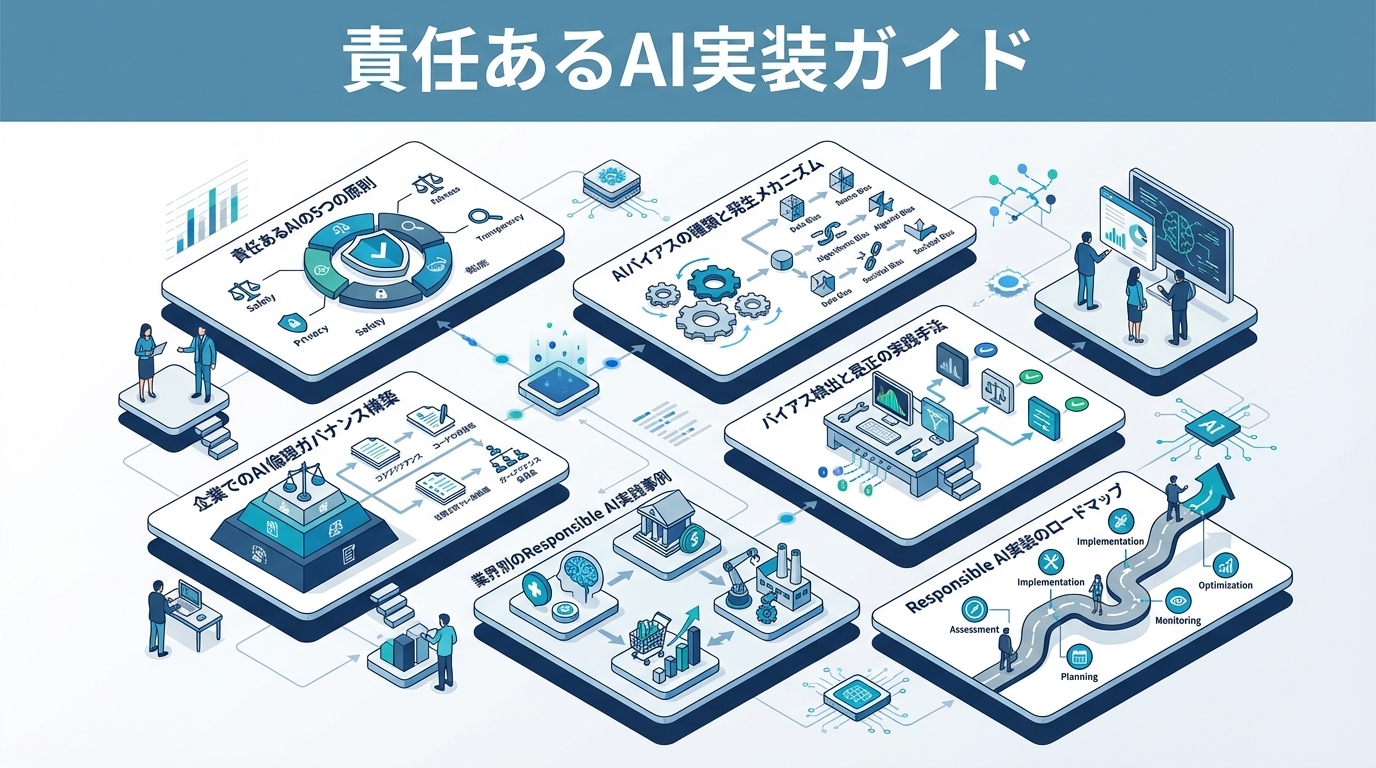

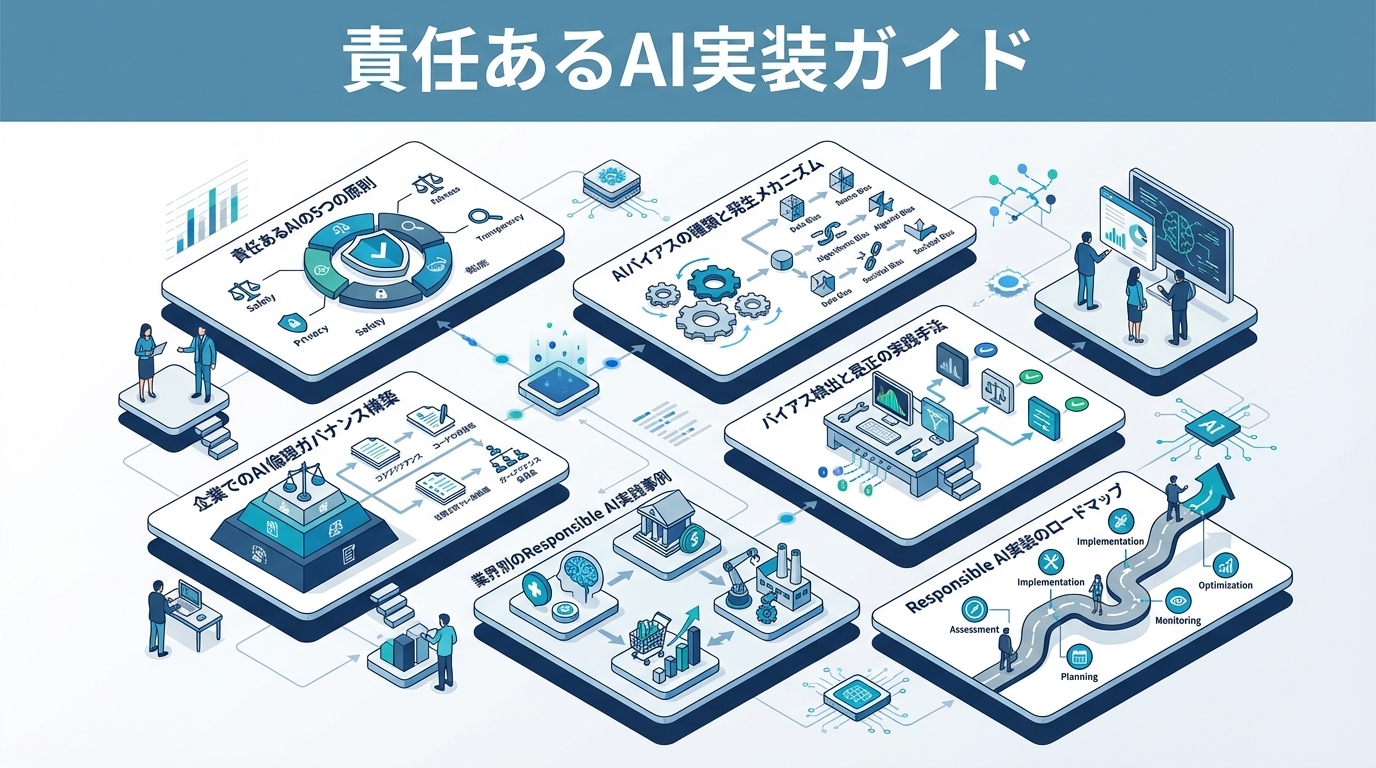

本記事では、責任あるAIを実装するための具体的な方法を解説します。AI活用完全ガイドで、AI活用の全体像を把握できます。

AI導入における倫理的リスクに対策を打ちたい経営者・AI推進担当者に向けた記事です。

本記事では、責任あるAIの基本原則から実装手法、ガバナンス構築までを体系的にまとめています。「AIを業務に導入する際の倫理的な配慮を知りたい」「AIバイアスのリスクに対策を打ちたい」という方は、詳しくは「RAG構築の実践ガイド」で解説しています。

AIシステムが特定の属性(性別、年齢、人種、地域など)に基づいて不当な差別を行わないことを保証する原則です。AIの判断が公平であるためには、学習データの偏り(バイアス)を検出・是正し、モデルの出力を定期的に監査する必要があります。詳しくは「AI SaaS市場動向」で解説しています。

公平性には複数の定義が存在し、ユースケースによって適切な定義が異なります。

すべての公平性定義を同時に満たすことは数学的に不可能な場合が多いため、自社のユースケースに適した公平性基準を選択することが重要です。

AIシステムがどのようなデータで学習され、どのようなロジックで判断を行い、どのような限界があるかを関係者に開示する原則です。AIの利用者やその判断の影響を受ける人々に対して、AIが使用されていること自体を明示する必要があります。

EUのAI規制法(EU AI Act)では、AIシステムの透明性要件として以下を義務づけています。

AIがなぜその判断を下したかを、人間が理解できる形で説明できる能力です。ブラックボックス化した深層学習モデルの判断根拠を説明する技術(XAI: Explainable AI)の研究が進んでいます。

代表的なXAI手法には以下があります。

ビジネスの場面では、「この顧客のスコアが高い理由」「この応募者が不合格になった理由」をAIが説明できることが、法的要件だけでなく信頼性の観点でも求められています。

AIの学習と推論に使用するデータにおいて、個人のプライバシーを保護する原則です。個人情報保護法、GDPR(EU一般データ保護規則)、CCPA(カリフォルニア州消費者プライバシー法)などの法規制に準拠するだけでなく、データの最小化(必要最小限のデータのみを収集・利用)を実践する必要があります。

差分プライバシー(Differential Privacy)は、個人のデータを特定できない形で学習データに追加するノイズの技術です。AppleやGoogleがユーザーデータの分析に採用しており、個人のプライバシーを数学的に保証しながらデータ分析を行えます。

AIシステムが意図した通りに安全に動作し、予期しない入力や攻撃に対しても堅牢であることを保証する原則です。AIセキュリティの具体的な防御策は「AIセキュリティの企業対策ガイド」で詳しく解説しています。

AIバイアスの最も一般的な原因は、学習データに内在する偏りです。歴史的なデータには、社会の偏見や構造的な不公平がそのまま反映されています。

Amazon社の採用AIの事例では、過去10年間の採用データを学習に使用していました。テック業界では男性の採用比率が高かったため、AIは「男性的な特徴を持つ履歴書を高く評価する」パターンを学習してしまいました。「女子大学」「女性サッカー部長」などの単語を含む履歴書のスコアが低く評価されるという結果につながっています。

学習データの収集方法に起因するバイアスです。たとえば、オンラインアンケートで収集したデータは、インターネットを日常的に利用する層に偏っています。このデータで学習したAIは、高齢者やデジタルデバイドの影響を受ける層の行動を正確に予測できません。

データの計測方法や変数の選択に起因するバイアスです。たとえば、与信審査AIで「住所の郵便番号」を特徴量として使用すると、特定の地域(低所得地域)の住民が一律に低いスコアを付けられるという、地理的差別(レッドライニング)につながる可能性があります。

モデルの設計やハイパーパラメータの選択に起因するバイアスです。特定のグループの精度を最大化するように最適化すると、マイノリティグループの精度が犠牲になる場合があります。

AIバイアスを検出するためのオープンソースツールが複数公開されています。

これらのツールを使って、モデルの予測結果を属性別に分析し、特定のグループに対して不公平な判定が行われていないかを検証します。

バイアスの緩和は、AIパイプラインの3つの段階で実施できます。

バイアスの検出と是正は、一度行えば終わりではありません。データの分布が変化すればバイアスも変化します。モデルの予測結果を定期的に(月次や四半期ごとに)属性別に分析し、公平性指標が基準値を逸脱していないかをモニタリングする体制が必要です。

AI倫理に関する意思決定を行う組織横断的な委員会を設置します。メンバーには、技術部門だけでなく、法務、人事、コンプライアンス、さらには外部の有識者を含めることが推奨されます。

AI倫理委員会の役割は以下のとおりです。

Google、Microsoft、IBMなどのテック大手はすべてAI倫理委員会を設置しており、Googleは「AI原則」として7つの指針を公開しています。

新たにAIシステムを導入する際は、事前にAIインパクトアセスメント(影響評価)を実施します。これは、AIシステムが個人や社会に与える潜在的な影響を事前に評価し、リスクを特定・軽減するプロセスです。

アセスメントで検討すべき項目は以下のとおりです。

AIの判断が人間の人生に重大な影響を与える場面(採用、与信、医療診断など)では、AIの判断を最終決定とせず、人間による最終確認のプロセスを組み込む「Human-in-the-Loop」の設計が不可欠です。

EU AI Actでは、高リスクAIシステムに対して人間による監督を義務づけています。AIは意思決定の「支援ツール」であり、最終的な判断権は人間に残すべきです。

AIを活用した採用選考では、バイアスのリスクが特に高い領域です。HireVueは、AIビデオ面接プラットフォームにおいて、顔の表情分析機能を2021年に廃止しました。顔の表情分析が特定の人種や障害のある候補者に不利に働く可能性が指摘されたためです。なお、こうしたAI活用については経営データの可視化サービスでも具体的な取り組みをご紹介しています。

採用AIでResponsible AIを実践するには、以下のアプローチが有効です。

採用プロセスでのAI活用については「AI採用プロセスガイド」でも解説しています。

金融分野では、AIによる与信審査のバイアスが特に問題視されています。Apple Cardの与信審査において、配偶者よりも男性に高い限度額が設定されたとの報告がSNSで拡散し、ニューヨーク州金融サービス局が調査に乗り出した事例があります。

金融機関では、AIの判断根拠を顧客に説明する義務(説明可能性要件)があり、XAI技術の導入が進んでいます。SHAP値を活用して「この顧客の与信スコアが低い主要因は、直近6ヶ月のクレジット利用率が80%を超えていることです」といった説明を自動生成するシステムが導入されています。

CRMに蓄積された顧客データをAIで分析し、ターゲティングやパーソナライゼーションを行う場合にも、バイアスのリスクがあります。たとえば、過去の購買データに基づいてAIが特定の年齢層や性別に対して異なる価格を提示する「動的価格設定」は、差別的な慣行として問題視される可能性があります。

HubSpotはプラットフォーム上でのAI機能(Breeze)において、AIの利用規約にResponsible AIの原則を明記し、差別的な利用を禁止するポリシーを設けています。AI導入効果の定量化とKPI設計についても、公平性の観点を取り入れることが重要です。詳しくは「AI生産性の測定方法」を参照してください。

企業がResponsible AIを段階的に実装するためのロードマップを示します。

StartLinkでは、HubSpot CRMのAI機能(Breeze)を活用する際のResponsible AI設計を支援しています。「AI活用のリスク評価を行いたい」「AI倫理ポリシーを策定したい」という方は、お気軽にご相談ください。

完全な排除は困難です。データには社会の偏見が反映されており、すべてのバイアスを除去することは現実的ではありません。重要なのは、バイアスを「検出・測定・緩和・モニタリング」する継続的なプロセスを構築することです。完全なゼロバイアスではなく、許容範囲内にバイアスを抑えることを目指します。

はい。AIを顧客対応や採用・営業プロセスに使用している場合、規模に関係なくバイアスのリスクが存在します。中小企業でも、利用するAIサービスの公平性に関する情報を確認する、AIの判断を鵜呑みにせず人間が最終判断する、といった基本的な取り組みは実施すべきです。

EUの市民に対してAIシステムのサービスを提供する場合、日本企業であっても適用対象になります。EUの顧客を持つBtoB企業や、EUに拠点を持つ企業は対応が必要です。また、日本でも同様の規制が今後整備される可能性が高いため、先行して対応しておくことを推奨します。

SHAPやLIMEなどのXAIライブラリはオープンソースで無料利用可能です。既存のPython環境にインストールするだけで、すぐに利用を開始できます。ただし、XAIの結果を非技術者にもわかりやすく表示するダッシュボードの構築や、運用プロセスの設計には、追加の開発工数が必要です。

はい。特に採用、与信、保険引受などの判断に影響を受ける個人には、AIの判断に異議を申し立て、人間による再審査を受ける権利を保証する仕組みが推奨されます。GDPRの第22条では、完全に自動化された意思決定に対する異議申し立ての権利が明記されています。

株式会社StartLinkは、事業推進に関わる「販売促進」「DXによる業務効率化(ERP/CRM/SFA/MAの導入)」などのご相談を受け付けております。 サービスのプランについてのご相談/お見積もり依頼や、ノウハウのお問い合わせについては、無料のお問い合わせページより、お気軽にご連絡くださいませ。

株式会社StartLink 代表取締役。累計150社以上のHubSpotプロジェクト支援実績を持ち、Claude CodeやHubSpotを軸にしたAI活用支援・経営基盤AXのコンサルティング事業を展開。

HubSpotのトップパートナー企業や大手人材グループにて、エンタープライズCRM戦略策定・AI戦略ディレクションを経験した後、StartLinkを創業。現在はCRM×AIエージェントによる経営管理支援を専門とする。