ソフトウェア開発において、コードレビューは品質を担保する最重要プロセスです。しかし、レビュアーの負担は年々増加し、レビュー待ちによる開発遅延は多くのチームが抱える慢性的な課題となっています。GitHub社の調査によると、プルリクエストの平均レビュー待ち時間は約4時間、大規模プロジェクトでは24時間を超えるケースも珍しくありません。詳しくは「非エンジニアでもAIで業務ツールが作れる」で解説しています。

ソフトウェア開発において、コードレビューは品質を担保する最重要プロセスです。しかし、レビュアーの負担は年々増加し、レビュー待ちによる開発遅延は多くのチームが抱える慢性的な課題となっています。GitHub社の調査によると、プルリクエストの平均レビュー待ち時間は約4時間、大規模プロジェクトでは24時間を超えるケースも珍しくありません。詳しくは「非エンジニアでもAIで業務ツールが作れる」で解説しています。

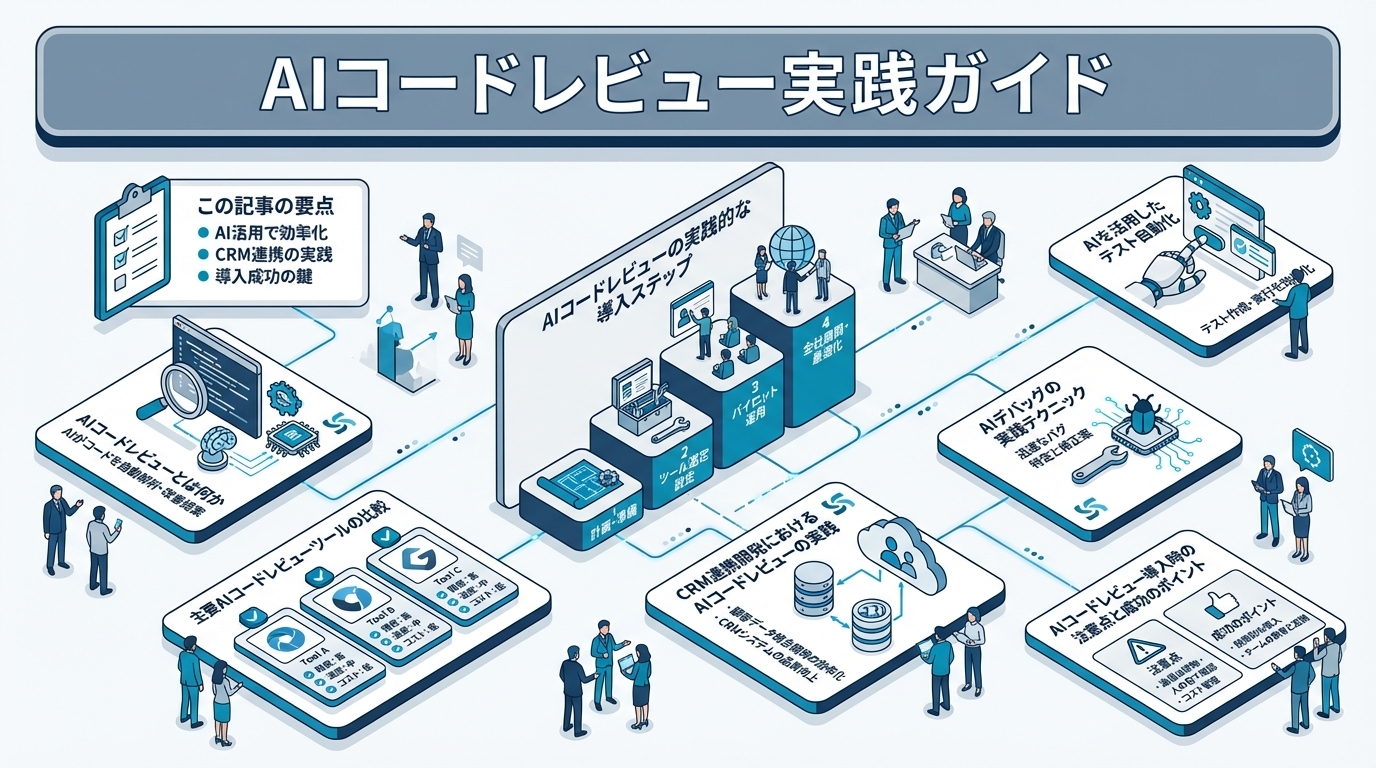

ブログ目次

HubSpot導入、AI活用、CRM整備、業務効率化までをまとめて支援しています。記事で気になったテーマを、そのまま相談ベースで整理できます。

ソフトウェア開発において、コードレビューは品質を担保する最重要プロセスです。しかし、レビュアーの負担は年々増加し、レビュー待ちによる開発遅延は多くのチームが抱える慢性的な課題となっています。GitHub社の調査によると、プルリクエストの平均レビュー待ち時間は約4時間、大規模プロジェクトでは24時間を超えるケースも珍しくありません。詳しくは「非エンジニアでもAIで業務ツールが作れる」で解説しています。

AIコードレビューは、この構造的なボトルネックを解消する手段として急速に普及しています。Claude Code、GitHub Copilot、Amazon CodeGuruといったツールは、セキュリティ脆弱性の検出、パフォーマンス改善の提案、コーディング規約の遵守チェックを数秒で実行します。AI活用完全ガイドで、AI活用の全体像を把握できます。

本記事では、AIコードレビューの基本概念から主要ツールの比較、テスト自動化・デバッグへの応用、そして実際の導入ステップまでを体系的に解説します。HubSpot API連携コードのレビューにおけるAI活用の実践知見も交えてお伝えします。詳しくは「ノーコードAIアプリ開発ガイド」で解説しています。

AIを活用した開発効率化の全体像については「Claude Code使い方完全ガイド」も併せてご覧ください。

コードレビューの負荷に悩む開発リーダーや、少人数チームで品質を担保したいエンジニアの方におすすめの内容です。

AIコードレビューとは、大規模言語モデル(LLM)や静的解析エンジンを活用して、ソースコードの品質を自動的に評価・改善するプロセスです。従来の静的解析ツール(ESLint、Pylintなど)がルールベースで問題を検出するのに対し、AIコードレビューはコードの「文脈」を理解した上で、より高度な指摘を行います。詳しくは「AIプロトタイピング入門」で解説しています。

従来の人間によるコードレビューは、レビュアーの経験・スキル・体調に品質が左右されるという本質的な課題を抱えています。金曜日の夕方に提出されたプルリクエストは月曜日まで放置され、レビュアーが疲れた状態で確認すれば見落としも増えます。

AIコードレビューは、以下の点で従来のプロセスを補完します。

ただし、AIは万能ではありません。ビジネス要件との整合性、アーキテクチャ設計の妥当性、チーム固有のコンテキストに基づく判断は、依然として人間のレビュアーが担うべき領域です。

AIコードレビューが得意とする検出領域は多岐にわたります。

特にAPI連携のコードにおいては、認証トークンの取り扱い、レートリミットへの対応、エラーリトライロジックの実装といった、見落としやすいが致命的な問題をAIが効率的に検出します。CRM連携API開発をAIで10倍速にする方法でも、API開発時の品質担保のポイントを解説しています。

2026年現在、AIコードレビューツールは急速に進化しており、それぞれ異なる強みを持っています。自社の開発環境や課題に合ったツールを選定するために、主要ツールを比較します。

Claude Code(Anthropic社)は、コードベース全体を理解した上で高度なレビューを実行できるAIエージェントです。ターミナルから直接操作でき、プロジェクトのディレクトリ構造、依存関係、設定ファイルを自動的に読み取ってコンテキストを把握します。

主な強み:

たとえば、HubSpot API連携コードのレビューをClaude Codeに任せることで、セキュリティ脆弱性の検出やパフォーマンス最適化の提案を自動化できます。特にOAuth認証フローやWebhook処理のコードでは、トークンの有効期限管理やリプレイ攻撃への対策など、人間が見落としがちな脆弱性をClaude Codeが指摘してくれるケースが多くあります。

Claude Codeの詳細な活用方法については「Claude Code使い方完全ガイド」で詳しく解説しています。

GitHub Copilot(Microsoft/GitHub社)は、コード補完機能で広く知られていますが、コードレビュー支援機能も強化されています。プルリクエストの自動レビュー機能(Copilot Code Review)では、変更内容を分析し、潜在的な問題点を自動的にコメントします。

主な強み:

GitHub Copilotのビジネス活用については「GitHub Copilot活用法」で詳しく解説しています。

Amazon CodeGuru(AWS社)は、機械学習を活用したコードレビューサービスです。AWSのエコシステム内で開発を行うチームにとって、インフラストラクチャとの親和性が高いのが特徴です。

主な強み:

SonarQube(SonarSource社)は、従来の静的解析ツールとしての実績が長く、AI機能を追加することで検出精度と修正提案の品質を向上させています。

主な強み:

| 項目 | Claude Code | GitHub Copilot | Amazon CodeGuru | SonarQube AI |

|---|---|---|---|---|

| 対応言語 | 全主要言語 | 全主要言語 | Java, Python中心 | 30言語以上 |

| 統合先 | ターミナル / CI | GitHub | AWS CodePipeline | CI/CD全般 |

| セキュリティ検出 | 非常に高い | 高い | 高い(AWS特化) | 非常に高い |

| コンテキスト理解 | プロジェクト全体 | PR単位 | リポジトリ単位 | リポジトリ単位 |

| 修正実行 | 自動修正可能 | 提案のみ | 提案のみ | 提案のみ |

| 導入コスト | 月額制 | 月額制 | 従量課金 | 無料〜有料 |

| オンプレミス対応 | 不可 | 不可 | 不可 | 対応 |

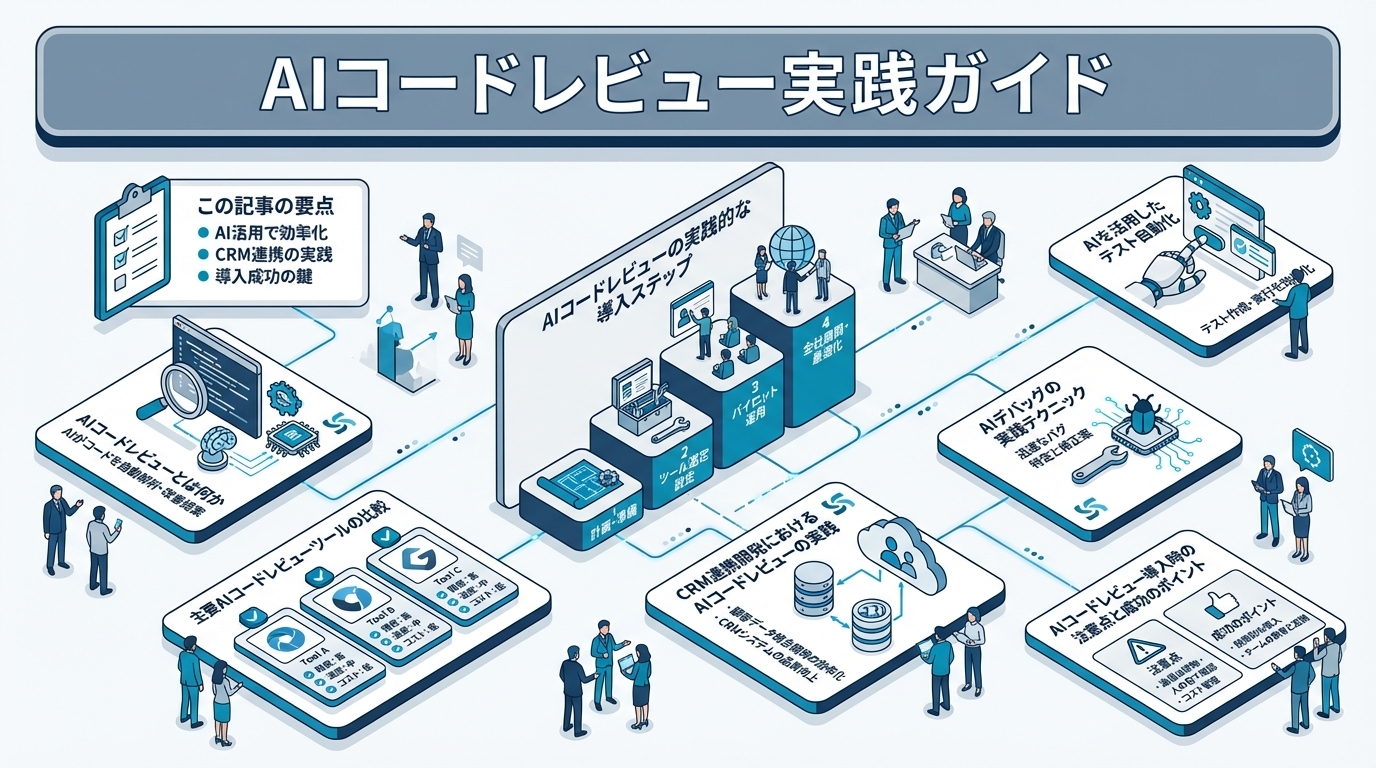

AIコードレビューを効果的に導入するには、段階的なアプローチが重要です。一気にすべてを自動化しようとすると、誤検知の多さにチームが疲弊し、結果としてAIの指摘を無視するようになってしまいます。

まず、現在のコードレビューにどれだけの時間とコストがかかっているかを数値化します。

これらのデータがあれば、AI導入後の改善効果を定量的に測定できます。

最も効果的な導入方法は、CI/CDパイプラインにAIコードレビューを組み込むことです。プルリクエストが作成された時点で自動的にAIレビューが実行され、結果がコメントとして投稿される仕組みを構築します。

GitHub Actionsを使う場合の基本的な流れは以下の通りです。

この仕組みにより、人間のレビュアーがプルリクエストを確認する前に、AIが基本的なチェックを完了しています。レビュアーは、AIが指摘した問題の妥当性確認と、AIでは判断できないビジネスロジックの検証に集中できます。

AIコードレビューの精度を高めるためには、チーム固有のコーディング規約やアーキテクチャルールをAIに伝えることが重要です。Claude Codeであれば、プロジェクトルートにCLAUDE.mdファイルを配置することで、プロジェクト固有のルールをAIに認識させることができます。CLAUDE.mdの活用法を含むClaude Codeの実践的な使い方は「Claude Code使い方完全ガイド」で詳しく解説しています。

設定すべきルール例:

AIコードレビューの延長線上にあるのが、AIを活用したテスト自動化です。AIは、コードの変更内容を分析して必要なテストケースを自動生成し、テストカバレッジの向上を支援します。なお、Claude Codeを活用した経営データの可視化やコンテンツマーケティングの支援についても、具体的な取り組みをご紹介しています。

Claude CodeやGitHub Copilotは、実装コードからテストコードを自動生成する機能を備えています。単体テスト、統合テスト、エッジケースのテストまで、AIが網羅的にテストケースを提案します。

たとえば、HubSpotのAPIクライアントコードに対して「このモジュールのテストを書いて」と指示するだけで、以下のようなテストケースが生成されます。

手動でこれらを網羅するには数時間かかる作業が、AIを使えば数分で完了します。もちろん、生成されたテストはそのまま使うのではなく、ビジネス要件に照らして過不足を確認することが必要です。

AIは、既存のテストスイートを分析し、カバレッジが不足している箇所を特定することもできます。単にカバレッジ率の数値だけでなく、「このブランチはビジネスクリティカルなロジックを含んでいるが、テストがない」といった文脈を踏まえた優先順位付けが可能です。

たとえば、HubSpot CRM連携のWebhookハンドラに対するテストカバレッジをAIで分析すると、コンタクトの重複マージ処理に関するエッジケースが未テストであることが判明するケースがあります。こうした指摘により、本番環境でのデータ不整合を未然に防ぐことができます。

コードの変更が既存機能に影響を与えていないかを確認するリグレッションテストは、プロジェクトが大きくなるほど実行時間が長くなります。AIは、コードの変更内容を分析し、影響を受ける可能性のあるテストケースだけを選択的に実行する「インパクト分析」を行えます。

これにより、全テストスイートの実行が30分かかるプロジェクトでも、変更に関連するテストだけを3分で実行し、迅速なフィードバックを得ることが可能になります。

バグの原因究明は、開発時間の中でも最もストレスフルで非効率な作業の一つです。AIを活用することで、デバッグのプロセスを大幅に効率化できます。

AIに対して、エラーログやスタックトレースを貼り付けて「このエラーの原因と修正方法を教えてください」と指示するだけで、原因の候補と修正案を提示してくれます。

Claude Codeの場合、プロジェクト全体のコードベースを理解した上で原因を推定するため、単にエラーメッセージを検索するよりもはるかに精度の高い診断が可能です。たとえば「このNullPointerExceptionは、3つ前のコミットで追加されたデータバリデーション処理のガード条件が不足しているために発生しています」といった、コミット履歴まで踏まえた分析を行えます。

AIは、コードの静的分析によるパフォーマンス問題の検出に加え、プロファイリング結果の解釈も得意としています。CPUプロファイルやメモリダンプをAIに読ませることで、以下のような分析が可能です。

本番環境で障害が発生した際、AIを活用して迅速にインシデント対応を行うことができます。直近のデプロイ差分、エラーログ、メトリクスデータをAIに渡すことで、原因の切り分けと一次対応策の提案を数分で得られます。

従来のインシデント対応では、複数のダッシュボードを確認し、ログを手動で検索し、チームメンバーと議論しながら原因を特定していました。AIを活用すれば、この初動のプロセスを大幅に短縮できます。

SaaSプロダクトやCRM連携の開発において、AIコードレビューは特に高い効果を発揮します。API連携のコードは、外部サービスとの通信を伴うため、セキュリティやエラーハンドリングの品質が直接的にビジネスリスクに影響するためです。

HubSpotを中心としたCRM連携アプリケーションの開発では、Claude CodeによるAIコードレビューを標準プロセスとして組み込むことで、大きな効果が得られます。

以下は、実際の開発で検出される典型的な事例です。

これらの問題は、経験豊富なエンジニアでも見落としがちなものです。AIを活用することで、セキュリティとリライアビリティの両面で品質を担保できます。

CRM連携のコードをAIでレビューする際に、重点的にチェックすべきポイントを整理します。

AIコードレビューの導入は、ツールを入れれば終わりではありません。チームの開発文化やプロセスに組み込み、継続的に改善していくことが成功の鍵です。

AIコードレビューの最大の課題は、誤検知(False Positive)です。実際には問題のないコードに対してAIが警告を出すケースは、導入初期には頻繁に発生します。

誤検知が多すぎると、開発者は「AIの指摘は信頼できない」と感じ、すべての指摘を無視するようになります。この「オオカミ少年化」を防ぐために、以下の対策が有効です。

AIと人間のレビュアーの最適な役割分担は、以下の通りです。

AIが担当すべき領域:

人間が担当すべき領域:

この分業により、人間のレビュアーは本来集中すべき高付加価値な判断に時間を使えるようになります。

AIコードレビューの導入を成功させるためのロードマップを示します。

フェーズ1(1〜2週間): パイロット導入。1つのリポジトリで、情報提供モード(ブロッキングなし)でAIレビューを実行。誤検知の傾向を把握する

フェーズ2(3〜4週間): ルール最適化。誤検知のフィードバックを反映し、チーム固有のルールを設定。重大な問題のみブロッキングに切り替え

フェーズ3(2〜3ヶ月): 全リポジトリ展開。パイロットで確立したルールを全リポジトリに適用。テスト自動生成やデバッグ支援も順次導入

フェーズ4(継続的): 効果測定と改善。レビュー待ち時間の短縮率、本番インシデントの減少率などのKPIを定期的に計測し、ルールを更新

StartLinkでは、HubSpotをはじめとするCRM連携開発において、AIを活用した開発プロセスの最適化を支援しています。AIコードレビューの導入やCRM連携の品質向上にお悩みの方は、ぜひお気軽にご相談ください。

いいえ、不要にはなりません。AIはパターンベースの問題検出に優れていますが、ビジネスロジックの正しさ、アーキテクチャ設計の妥当性、チームのコンテキストに基づく判断は人間にしかできません。AIは人間のレビュアーの負担を軽減し、より高付加価値な判断に集中できる環境を作るためのツールです。

これは企業のセキュリティポリシーに依存します。Claude CodeやGitHub Copilotは、エンタープライズプランでデータの外部学習への不使用を保証しています。セキュリティ要件が厳しい場合は、SonarQubeのようなオンプレミスで動作するツールを選択するか、AIベンダーとのデータ処理契約(DPA)を締結した上で利用してください。

主要な言語(JavaScript/TypeScript、Python、Java、Go、Rustなど)では非常に効果的です。AIの学習データにおけるコード量が多い言語ほど精度が高い傾向にあります。マイナーな言語やドメイン固有言語(DSL)では精度が下がる場合がありますが、Claude Codeのようにプロジェクト全体のコンテキストを読み取るツールであれば、言語に依存しない構造的な問題は検出可能です。

ツールによって異なりますが、GitHub Copilot Businessは1ユーザーあたり月額19ドル、Claude Code(Claude MAX)は月額200ドルから利用できます。Amazon CodeGuruは分析したコード行数に応じた従量課金です。SonarQubeはCommunity Editionが無料、Enterprise Editionが有料です。多くの場合、レビュー待ち時間の短縮とバグの早期発見による手戻り削減で、導入コストは短期間で回収できます。

むしろ小規模チームこそAIコードレビューの効果が大きいと言えます。少人数チームでは、レビュアーが限られるためレビューの品質にばらつきが出やすく、セキュリティやパフォーマンスの専門知識が不足しがちです。AIが「第二の目」として機能することで、少人数でも高い品質を維持できます。特にスタートアップや少人数チームでは、Claude Codeによるレビューが品質担保の要となります。

株式会社StartLinkは、事業推進に関わる「販売促進」「DXによる業務効率化(ERP/CRM/SFA/MAの導入)」などのご相談を受け付けております。 サービスのプランについてのご相談/お見積もり依頼や、ノウハウのお問い合わせについては、無料のお問い合わせページより、お気軽にご連絡くださいませ。

株式会社StartLink 代表取締役。累計150社以上のHubSpotプロジェクト支援実績を持ち、Claude CodeやHubSpotを軸にしたAI活用支援・経営基盤AXのコンサルティング事業を展開。

HubSpotのトップパートナー企業や大手人材グループにて、エンタープライズCRM戦略策定・AI戦略ディレクションを経験した後、StartLinkを創業。現在はCRM×AIエージェントによる経営管理支援を専門とする。