データクレンジングの本質と、CRM運用における位置づけ。CRMデータ品質が劣化する5つの原因と、それぞれの対策。

データクレンジングの本質と、CRM運用における位置づけ。CRMデータ品質が劣化する5つの原因と、それぞれの対策。

ブログ目次

HubSpot導入、AI活用、CRM整備、業務効率化までをまとめて支援しています。記事で気になったテーマを、そのまま相談ベースで整理できます。

データクレンジングの本質と、CRM運用における位置づけ。CRMデータ品質が劣化する5つの原因と、それぞれの対策。

「CRMに重複レコードが増え続けて、どれが正しいデータかわからない」「営業が入力するデータの表記がバラバラで、レポートの数字が信用できない」「名寄せをしたいが、どこから手をつければいいのか見当がつかない」――CRM運用が軌道に乗り始めた企業ほど、こうしたデータ品質の問題に直面します。

CRMは「入力→蓄積→活用」のデータサイクルで価値を発揮する仕組みですが、このサイクルが回り続けるためには、蓄積されるデータの品質を維持・向上させる仕組みが不可欠です。CRM導入の進め方の段階からデータ品質を意識した設計を行うことが、運用定着の鍵を握ります。データクレンジングとは、まさにこの「データ品質の維持・向上」を設計し、運用に組み込むための取り組みです。

本記事では、CRM導入支援の現場で培った実務ノウハウをもとに、データクレンジングの設計思想と具体的な運用方法を解説します。名寄せの考え方、重複管理の仕組み、データ品質が劣化する原因とその対策、そしてHubSpotにおける実装パターンまで、CRM設計者・運用担当者がすぐに活用できる知見を体系的にお伝えします。

データクレンジングとは、CRMに蓄積されたデータの誤り・重複・不整合・欠損を検出し、修正・統合・補完する一連のプロセスのことです。日本語では「データ浄化」「データクリーニング」とも呼ばれます。

ここで重要なのは、データクレンジングは「一度やって終わり」のプロジェクトではなく、CRM運用に組み込む継続的な仕組みであるという点です。データは日々入力・更新・インポートされるため、品質は放置すれば確実に劣化します。クレンジングを一回限りのイベントとして捉えるのではなく、運用プロセスの一部として設計することが、データ品質を持続的に維持するための前提条件です。

データクレンジングは、以下の4つの基本アクションに分解できます。

この4つのアクションを体系的に設計し、運用に組み込むことがデータクレンジングの全体像です。

CRMデータベース設計の基本では、「オブジェクト」「プロパティ」「関連付け」の3つの構成要素による設計思想を解説しました。データベース設計が「きれいなデータを蓄積するための器」を整える作業だとすれば、データクレンジングは「器に入ったデータの品質を維持する」ための仕組みづくりです。

どれほど優れた設計をしても、運用の中でデータは汚れていきます。入力ミス、表記ゆれ、重複作成、情報の陳腐化は避けられません。だからこそ、設計と並行してクレンジングの仕組みを組み込むことが、CRM運用の成功に不可欠なのです。

データクレンジングの具体的な手法に入る前に、なぜデータ品質が劣化するのかを理解しておく必要があります。原因を正確に把握していなければ、対策は対症療法に留まります。CRM導入支援の実務経験から、データ品質が劣化する原因は以下の5つに集約されます。

データ品質劣化の最も根本的な原因は、入力ルールが定められていない、あるいは定めていても徹底されていないことです。

例えば、会社名の入力ひとつをとっても、「株式会社」を前につけるか後につけるか、「(株)」と略すか、英語表記と日本語表記のどちらを使うか。こうしたルールが不明確だと、同じ企業が「株式会社ABC」「ABC株式会社」「(株)ABC」「ABC Inc.」として複数レコード登録されます。結果として、名寄せが困難になり、レポートの数値が分散し、正確な全体像が把握できなくなります。

入力ルールの問題は、プロパティのフィールドタイプとも密接に関係します。自由記述(テキスト)フィールドが多いほど入力のバラつきが増え、選択式(ドロップダウン、ラジオボタン等)フィールドが多いほどデータの一貫性が保たれます。ただし、選択肢が現実の業務と乖離していると、「その他」に集中したり、そもそも入力されなかったりするため、選択肢の設計自体にも注意が必要です。

重複レコードは、CRMにおけるデータ品質問題の中で最も頻繁に発生し、かつ最も影響が大きい問題です。重複が発生する主な経路は以下の通りです。

重複レコードの何が問題かというと、単に「同じレコードが2つある」にとどまりません。情報が分散し、どのレコードが「正」かわからなくなることが本質的な問題です。Aさんの活動履歴がレコードAとレコードBに分かれていれば、Aさんとの関係性の全体像が見えなくなります。営業Aが知っている情報を営業Bが知らない、という事態が発生します。

ビジネスの世界では、情報は常に変化しています。担当者の異動・退職、企業の合併・社名変更、電話番号やメールアドレスの変更。こうした変化に対応しなければ、CRMに蓄積されたデータは時間とともに実態と乖離していきます。

一般的に、BtoBの顧客データは年間約20〜30%のペースで陳腐化すると言われています。つまり、何もしなければ3〜5年でデータベースの大半が実態と合わなくなる計算です。この経年劣化への対策を怠ると、メール配信のバウンス率が上がり、営業が古い情報を元にアプローチして信頼を損なうリスクが生じます。

展示会で獲得した名刺データ、購入したリストデータ、他システムからの移行データなど、外部からデータを取り込む場面はCRM運用において頻繁に発生します。このとき、外部データの品質がそのままCRM全体のデータ品質に影響します。

外部データには、表記ゆれ、フォーマットの不統一、不正確な情報、古い情報が含まれていることが多くあります。これらを無検証でインポートすると、それまで維持してきたデータ品質が一気に劣化します。「インポートは品質リスクの最大の入口」と認識し、取り込み前のクレンジングプロセスを必ず設けることが重要です。

運用開始当初はルールが守られていても、担当者の異動や組織の拡大に伴い、ルールが属人化・形骸化するケースが多く見られます。

運用ルールの設計と維持についてはCRM運用ルール設計ガイドで詳しく解説していますが、ここではルールの形骸化がデータ品質劣化の構造的な原因になるという点を強調しておきます。

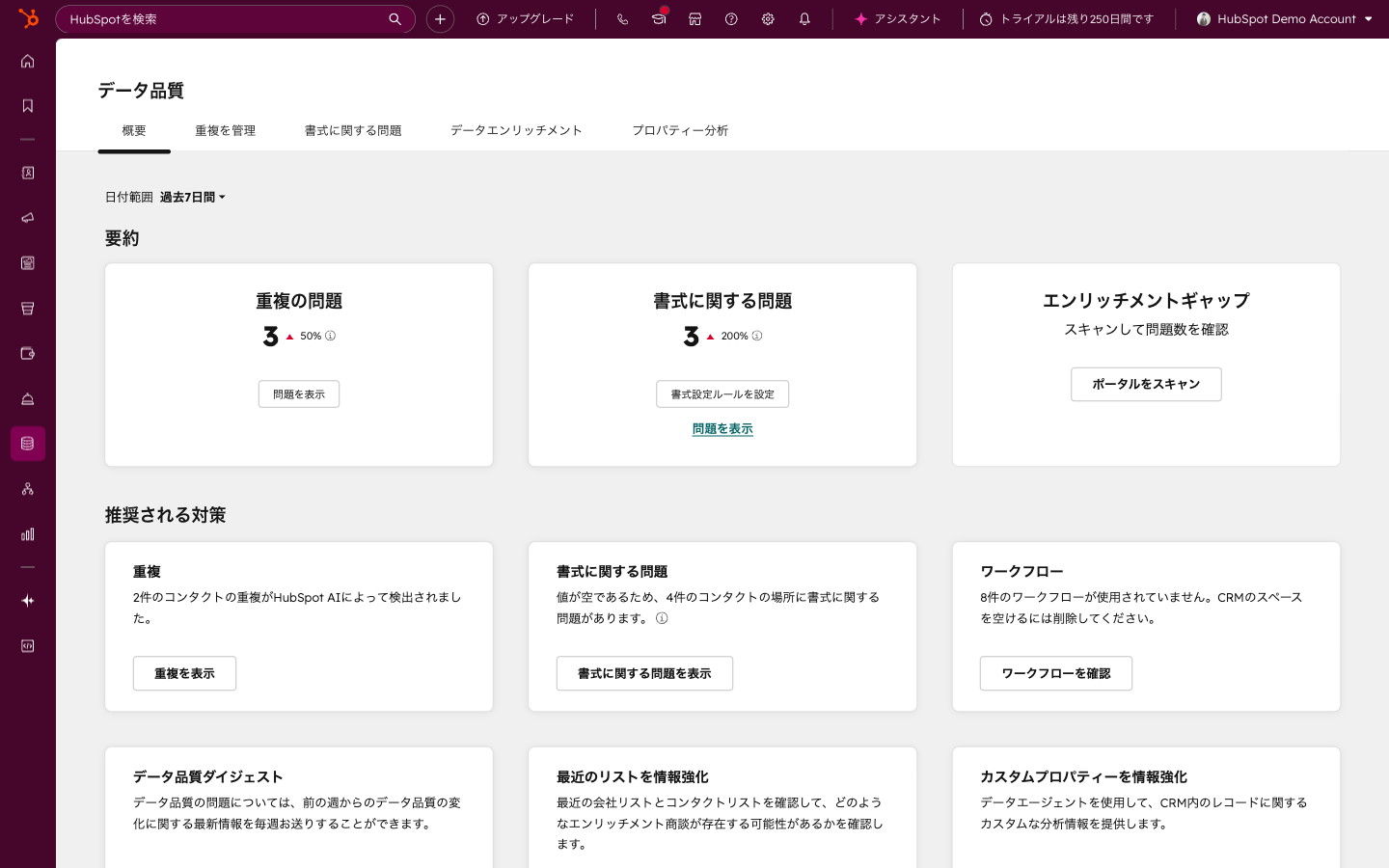

データクレンジングの設計にあたっては、まず「データ品質とは何か」を定量的に定義する必要があります。品質の定義が曖昧なままでは、改善の進捗を測定できず、取り組みが形骸化します。

これらの評価軸を組み合わせて、データ品質スコアカードを設計することを推奨します。スコアカードとは、データ品質の状態を定量的に一覧化し、定期的にモニタリングするための指標体系です。

例えば、以下のような形式です。

スコアカードは月次で確認し、目標値を下回った項目に対してアクションを講じるサイクルを回します。これにより、データ品質の改善が「感覚」ではなく「数値」に基づくものになります。

名寄せとは、同一の実体(人物・企業)を指す複数のレコードを特定し、1つのレコードに統合するプロセスです。CRMデータクレンジングにおいて、名寄せは最も技術的な難度が高く、かつビジネスインパクトが大きい領域です。

名寄せの設計で最初に決めるべきは、何を基準に「同一」と判断するかという一意キー(ユニークキー)の定義です。

HubSpotの場合、コンタクトはメールアドレスを一意キーとして自動的に重複を防ぐ仕組みがあります。同じメールアドレスのコンタクトが既に存在する場合、新規レコードは作成されず、既存レコードが更新されます。この仕組みを活用するためにも、メールアドレスの入力を徹底することが重要です。

一方、会社オブジェクトについてはドメイン名を一意キーとして管理するのが有効です。HubSpotでは会社の「ドメイン名」プロパティを使って重複を検出する仕組みが用意されています。

名寄せには、以下の3つのアプローチがあります。自社の状況に応じて適切なアプローチを選択、あるいは組み合わせることが重要です。

アプローチ1:完全一致マッチング

一意キーが完全に一致するレコードを名寄せ対象とする方法です。メールアドレスや企業ドメインなど、表記ゆれが発生しにくい項目を使う場合に有効です。精度は高いが、検出漏れ(表記ゆれによるマッチ失敗)が発生しやすいという特性があります。

アプローチ2:あいまい一致マッチング

レーベンシュタイン距離(編集距離)やサウンデックスなどのアルゴリズムを使い、「似ている」レコードを名寄せ候補として検出する方法です。「株式会社ABC」と「ABC株式会社」、「田中太郎」と「田中 太郎」(スペースの有無)のような表記ゆれを検出できます。検出範囲は広がるが、誤検出(異なる実体を同一と判定)のリスクがあるため、最終的な判断は人間が行う運用が望ましいです。

アプローチ3:ルールベースマッチング

「会社名が同一」かつ「電話番号の下4桁が一致」のように、複数の条件を組み合わせたルールで名寄せ候補を検出する方法です。自社の業務特性に合わせたカスタマイズが可能で、完全一致とあいまい一致の中間的なバランスを取れます。

重複レコードを統合する際には、どのレコードを残し(マスターレコード)、どのレコードを統合先に吸収させるかを決めるルールが必要です。以下の優先順位で判断することを推奨します。

HubSpotのマージ機能では、マスターレコードを選択した上で、統合元レコードのプロパティ値を個別に引き継ぐかどうかを選べます。活動履歴やチケット、取引などの関連レコードは、統合後のレコードにすべて引き継がれます。

重複管理は、「発生した重複を統合する」だけでは不十分です。「防止」「検知」「統合」の3層構造で仕組みを設計することが、持続的なデータ品質維持の鍵です。

最も効果的な重複管理は、そもそも重複を発生させないことです。以下の施策を組み合わせることで、重複の発生を大幅に抑制できます。

施策1:一意キーの自動照合

レコード作成時に一意キー(メールアドレス、ドメイン等)で自動照合を行い、既存レコードが存在する場合はアラートを出す、または自動的に既存レコードを更新する仕組みを構築します。HubSpotでは、コンタクトのメールアドレスによる自動重複防止が標準機能として備わっています。

施策2:インポート時のプレチェック

外部データのインポート前に、既存データとの照合チェックを実施します。インポートファイルと既存レコードの一意キーを突合し、一致するレコードは「新規作成」ではなく「更新」として処理します。HubSpotのインポート機能では、一意識別子(メールアドレスやレコードID)を指定することで、新規作成と更新を自動で振り分けることが可能です。

施策3:フォーム送信時の自動マッチング

Webフォームから送信されたデータが、既存コンタクトと自動的にマッチングされるよう設定します。HubSpotフォームでは、メールアドレスを必須項目にすることで、既存コンタクトとの自動照合が機能します。同じメールアドレスからのフォーム送信は、新規レコード作成ではなく既存レコードの更新として処理されます。

施策4:入力画面での既存レコード表示

レコードを手動作成する際に、入力途中で類似のレコードが存在するかどうかを画面上に表示する仕組みです。これにより、ユーザーが重複レコードを作成する前に既存レコードの存在に気づけます。

防止策を講じても、重複の発生をゼロにすることは困難です。そのため、発生した重複を速やかに検知する仕組みが必要です。

検知方法1:CRM標準の重複管理機能

HubSpotには、AIを活用した重複管理ツールが標準で搭載されています。コンタクトと会社のレコードを自動的にスキャンし、重複候補をリストアップします。メールアドレス、氏名、会社名、電話番号などを総合的に分析し、重複の可能性があるレコードのペアを提示します。

検知方法2:定期的なレポートによる監視

以下のようなレポートを作成し、定期的に確認することで重複の兆候を検知します。

検知方法3:ワークフローによるアラート

特定の条件(例:同じ会社名で新規会社レコードが作成された場合)をトリガーにしたワークフローを設定し、管理者にアラート通知を送る仕組みです。リアルタイムに近い検知が可能になります。

検知された重複レコードを実際に統合するプロセスです。統合にあたっては、以下の手順で進めます。

HubSpotでは、コンタクトと会社のマージが標準機能として提供されています。マージ時には、両方のレコードのプロパティ値を比較し、どちらの値を残すかをプロパティごとに選択できます。また、活動ログ、関連付けられた取引やチケット、リストメンバーシップなどは、統合後のレコードにすべて引き継がれます。

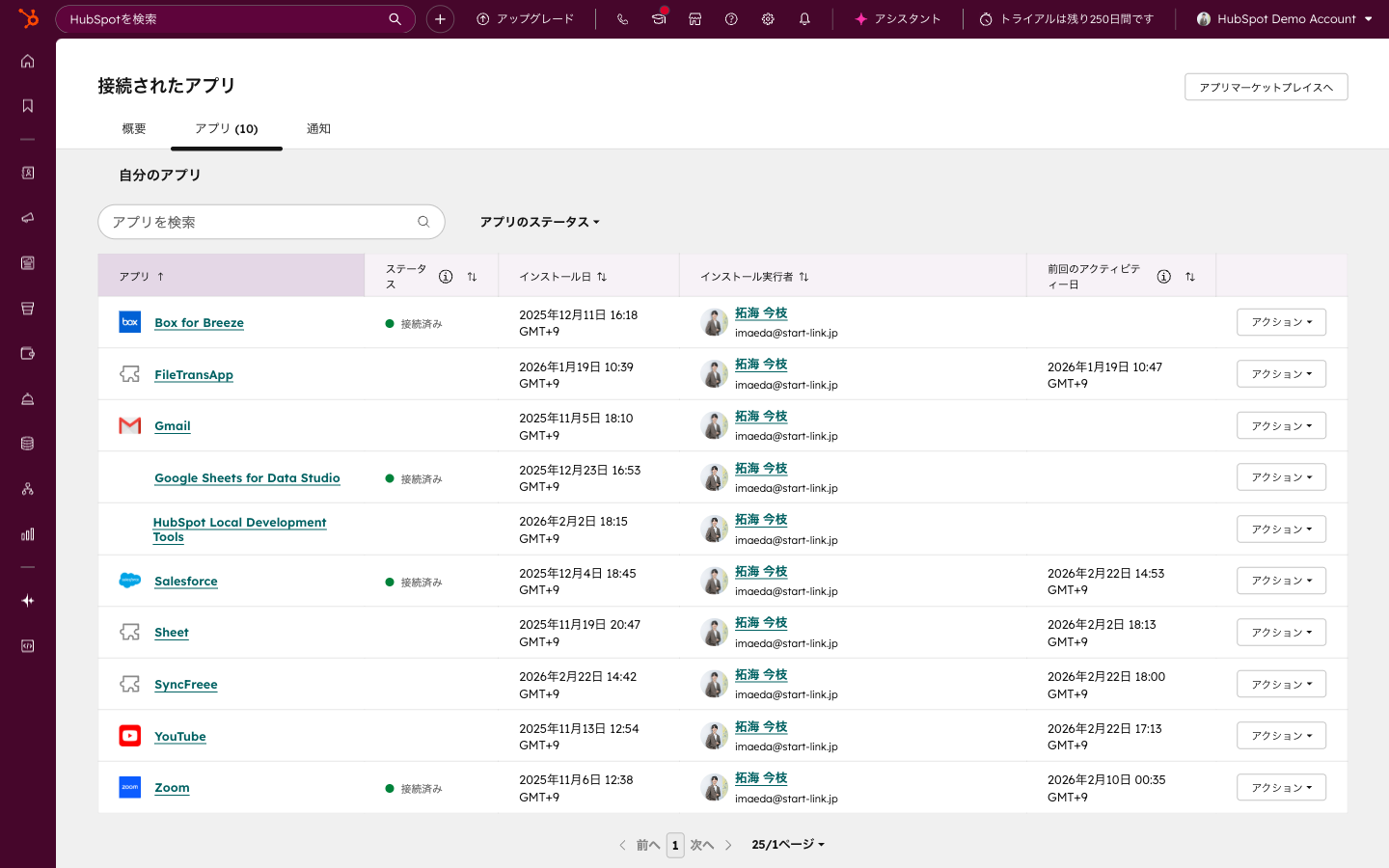

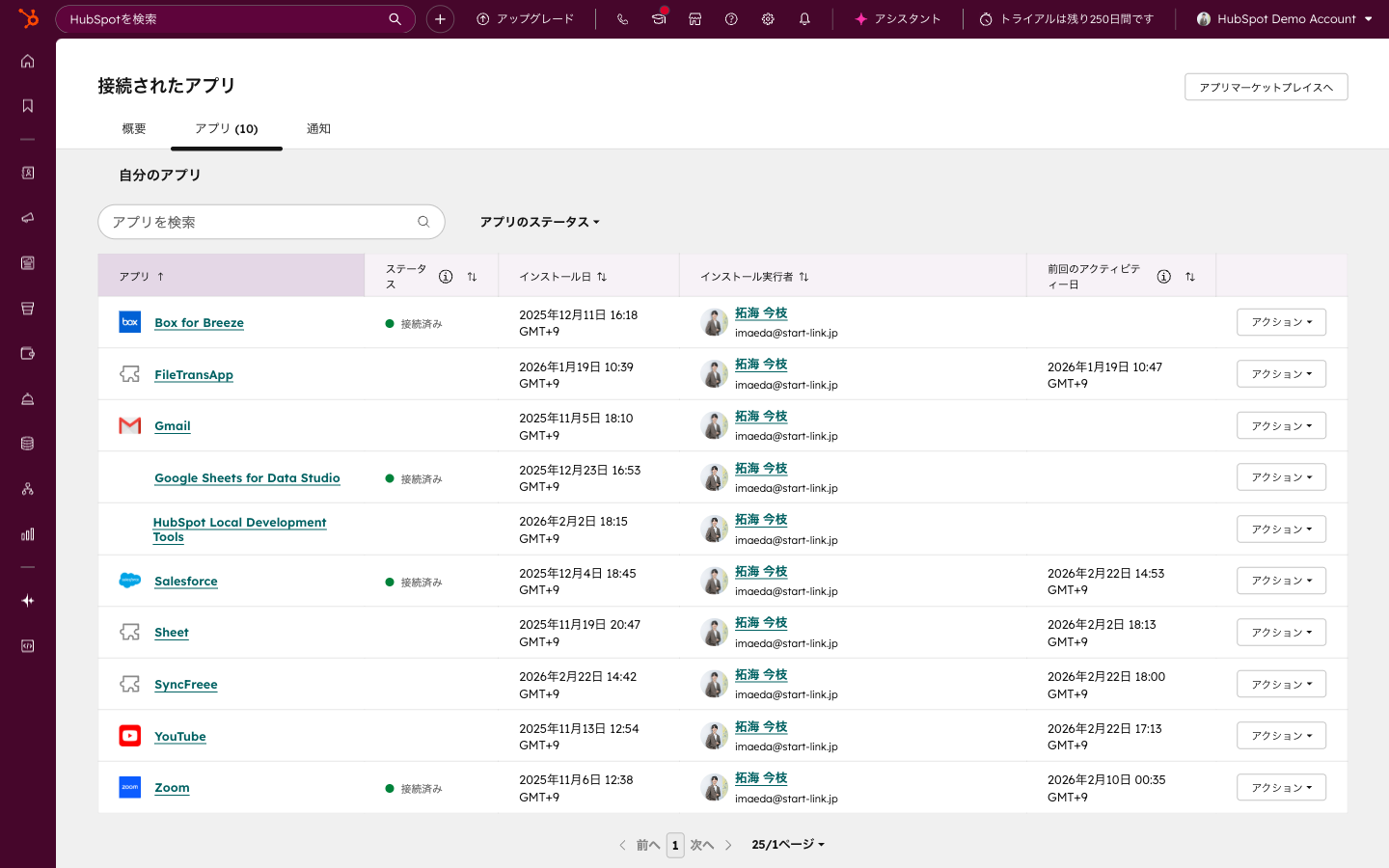

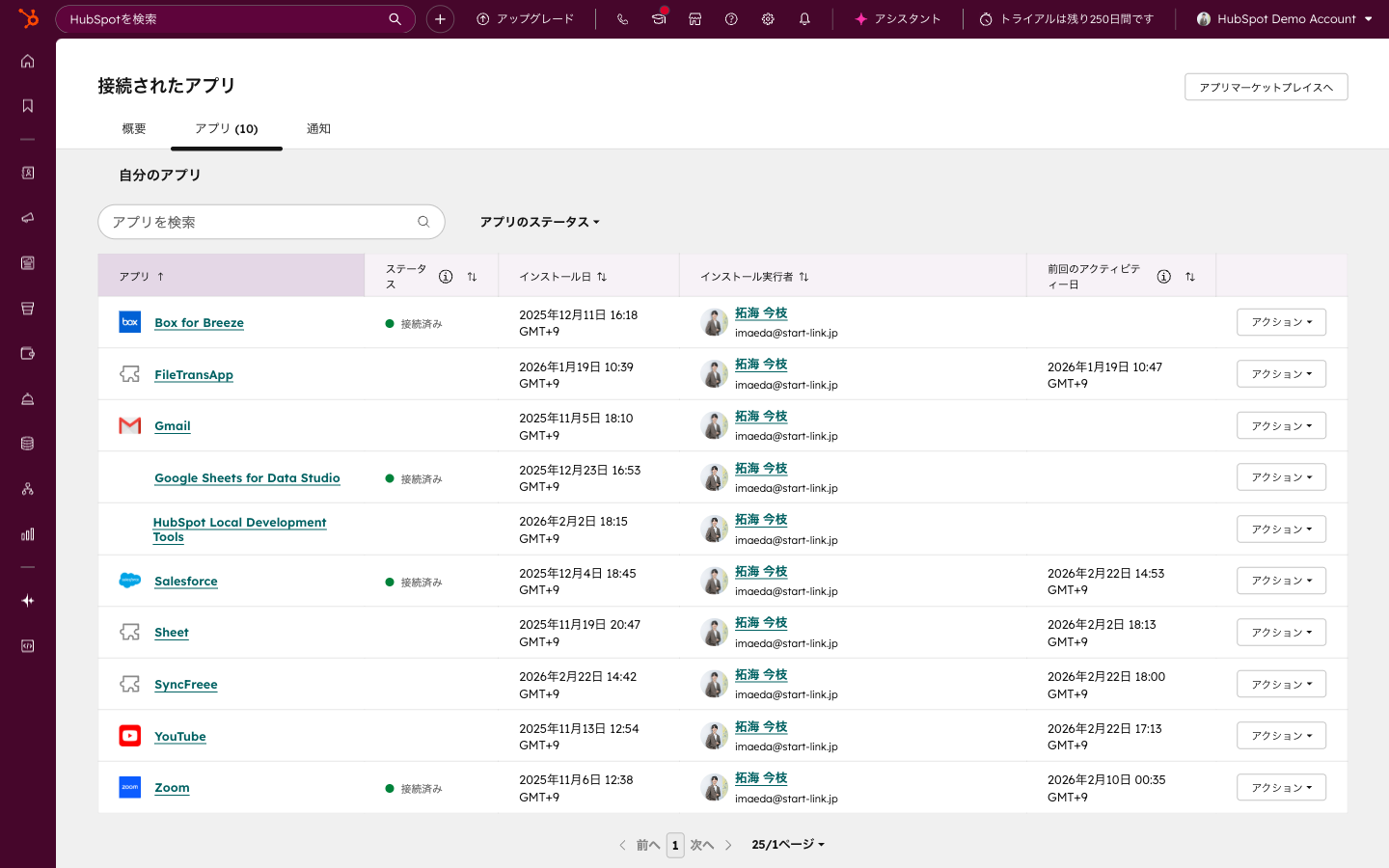

ここからは、HubSpotの具体的な機能を活用したデータクレンジングの実装パターンを解説します。

HubSpotの標準機能だけでも、基本的なデータクレンジングは十分に実行可能です。

HubSpotのData Hubは、データ品質の自動化に特化した機能群を提供します。標準機能では対応しきれない高度なクレンジング要件がある場合に活用します。

データ品質自動化(Data Quality Automation)

Data Hubの「データ品質自動化」機能では、以下のようなデータ修正を自動的に実行できます。

これらの処理は、レコードが作成・更新されるたびに自動的に実行されるため、「入力された瞬間にデータがクリーンになる」という理想的な状態を実現できます。

カスタムコード(Programmable Automation)

Data Hub Professional以上のプランでは、ワークフロー内にカスタムコード(JavaScript / Python)を組み込むことができます。これにより、標準機能では対応できない複雑なクレンジングロジックを実装できます。

データ同期(Data Sync)

Data Hubのデータ同期機能は、外部アプリケーションとの双方向データ同期を提供します。データ同期において重要なのは、同期フィールドのマッピングとコンフリクト解決ルールの設計です。

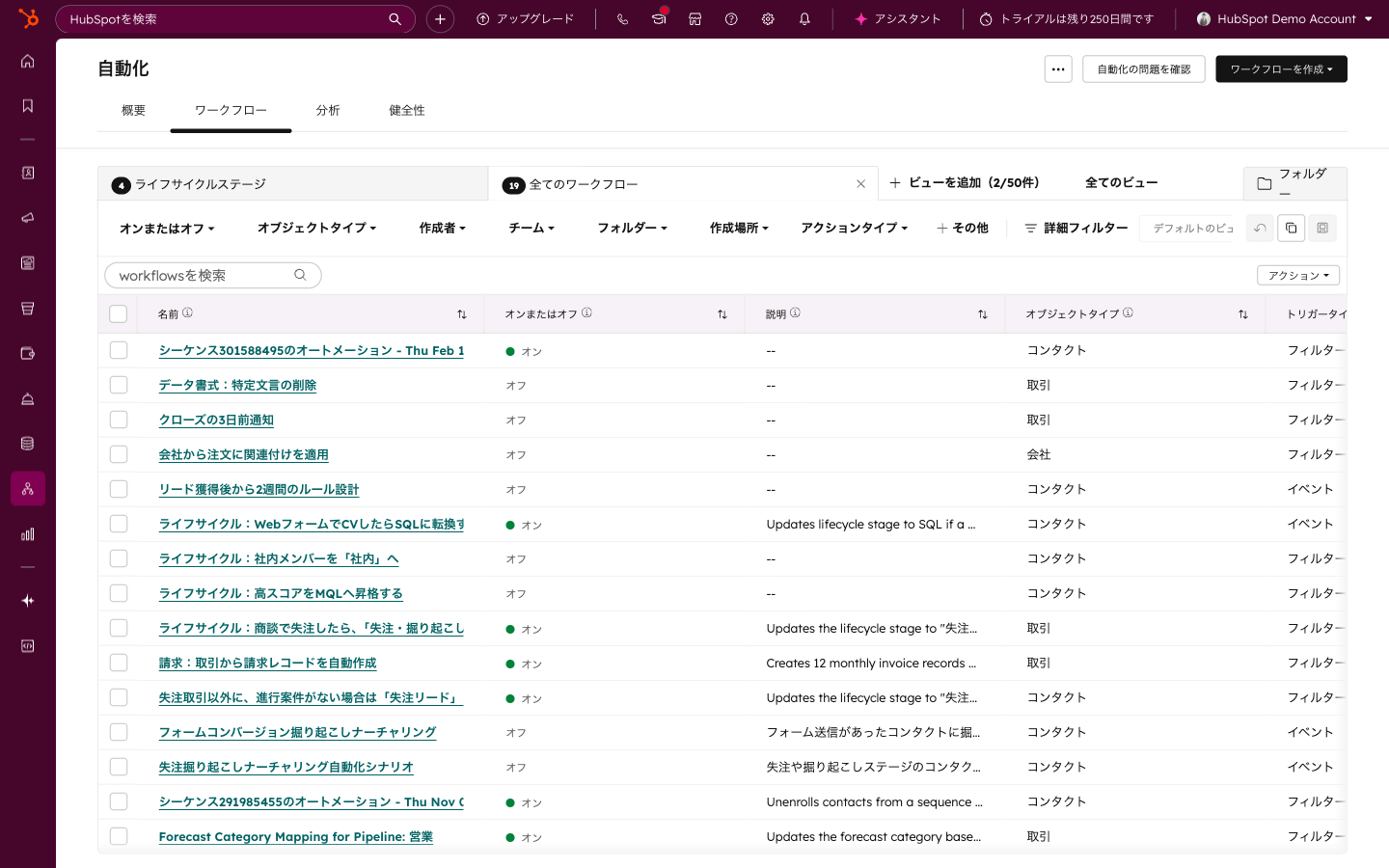

HubSpotのワークフロー機能を使って、データクレンジングの一部を自動化するパターンです。以下に実践的な例を紹介します。

例1:電話番号のフォーマット統一

トリガー:コンタクトのプロパティ「電話番号」が更新されたとき。アクション:電話番号の形式をチェックし、統一フォーマット(例:03-1234-5678形式)に変換する。Data Hubのデータ品質自動化で対応可能です。

例2:未関連付けレコードのアラート

トリガー:コンタクトが作成されてから24時間経過したとき。条件:会社との関連付けがない場合。アクション:CRM管理者にタスクを作成し、関連付けの確認を依頼する。

例3:古いレコードの再確認アラート

トリガー:コンタクトの「最終活動日」から180日が経過したとき。アクション:レコードオーナーに「情報の鮮度を確認してください」というタスクを作成する。

例4:インポートデータの自動品質チェック

トリガー:レコードのソースが「インポート」であるとき。アクション:必須項目(メールアドレス、会社名、業種)が入力されているかチェックし、不足がある場合は管理者にアラートを送信する。

データクレンジングを持続的に機能させるためには、技術的な仕組みだけでなく、組織的な運用設計が不可欠です。

データクレンジングの運用サイクルは、以下の3つの頻度で設計することを推奨します。

データクレンジングの運用を属人化させないためには、明確な役割分担を定義することが重要です。

特に重要なのは、「データオーナー」を明確に定義することです。データ品質に対する最終的な責任者が不在だと、「誰の責任でもない」状態となり、品質は確実に劣化します。運用ルール全体の設計についてはS-8の記事で体系的に解説しています。

外部データの取り込みは、データ品質を大きく左右するイベントです。以下のプロセスをインポートの標準手順として定めることを推奨します。

発生してしまったデータ品質の問題に対処するクレンジングも重要ですが、より本質的なのは品質劣化を予防する仕組みを設計段階で組み込むことです。

プロパティの設計段階で品質を担保する仕組みを組み込みます。

入力ルールを文書化し、全ユーザーがアクセスできるようにします。

CRMの権限設計を活用して、データ品質に関するガバナンスを構築します。

CRMにおけるAI活用が急速に進む中、「AIの判断精度=データ品質」という等式はますます重要性を増しています。AI機能がどれほど高度であっても、学習・判断の材料となるデータの品質が低ければ、アウトプットの精度は低くなります。

CRMにおけるAI機能は、蓄積されたデータを学習・分析することで価値を生み出します。具体的には、以下のようなAI機能がデータ品質に直接依存しています。

「Garbage In, Garbage Out(ゴミを入れればゴミが出る)」は情報処理の古典的な原則ですが、AI時代においてはさらに深刻な意味を持ちます。従来のレポートやダッシュボードであれば、数値を見た人間が「このデータは信頼できない」と判断できました。しかし、AIが自動的に判断・実行する場面では、低品質データに基づく誤った判断がそのまま実行されるリスクがあります。

例えば、AIベースのリードスコアリングが低品質データに基づいて低い優先度をつけたリードが、実は大型案件の意思決定者だったとしたら、機会損失は計り知れません。AIが高度になればなるほど、その前提となるデータ品質の重要性は増していきます。

だからこそ、データクレンジングは「運用のメンテナンス」ではなく、「AI活用の基盤構築」として位置づけるべきなのです。CRMにおけるAI活用の詳細については、W-2の記事も参照してください。

既にデータ品質の問題を抱えている場合、どのようにクレンジングプロジェクトを進めるべきかを解説します。

まず、現在のデータ品質がどの程度かを定量的に把握します。

この可視化によって、「どの領域のデータ品質が最も問題か」が明確になり、優先順位をつけた対策が可能になります。

すべてのデータ品質問題に同時に取り組むのは現実的ではありません。ビジネスインパクトが大きい問題から優先的に対処するのが原則です。

優先順位に基づいて、実際のクレンジング作業を実行します。大量のレコードを対象にする場合は、以下の点に注意してください。

クレンジングプロジェクトと並行して、前述の予防策(プロパティ設計の見直し、入力ガイドラインの整備、ワークフローによる自動化)を導入します。クレンジングだけを行って予防策を導入しなければ、時間の経過とともに同じ問題が再発します。

データ品質スコアカードに基づく定期的なモニタリングの仕組みを確立し、品質の推移を追跡します。品質が低下した場合にすぐに気づき、対策を講じられる体制を整えることが、クレンジングプロジェクトの成果を持続させる鍵です。

CRM導入支援の経験から、データクレンジングに取り組む企業の成功パターンと失敗パターンを整理します。

CRMデータクレンジングは、「汚れたデータを掃除する」という後処理ではなく、データ品質を維持・向上させるための継続的な仕組みづくりです。本記事で解説したポイントを整理すると、以下の通りです。

データクレンジングの取り組みは、短期的には地味で成果が見えにくいかもしれません。しかし、データ品質の維持・向上は、CRMの「入力→蓄積→活用」サイクルを支える基盤であり、将来のAI活用の天井を決める要素です。データベース設計(S-1)で整えた「器」の品質を維持し、運用ルール(S-8)の中にクレンジングの仕組みを組み込むことで、CRMは真にビジネスを推進する情報基盤として機能し続けます。

A. CRM導入前のデータ移行時が最初のクレンジングタイミングです。旧システムのデータをそのまま移行すると、品質問題もそのまま引き継がれます。移行前にクレンジングを実施し、きれいなデータでCRMをスタートさせることを推奨します。ただし、導入前のクレンジングだけでは不十分で、導入後も継続的なクレンジング運用を組み込むことが必須です。予防策(プロパティ設計、入力ルール、ワークフロー自動化)は導入時に設計し、運用サイクル(週次の重複確認、月次の品質レビュー)は導入直後から開始しましょう。

A. 大量の重複がある場合、一度にすべてを手動マージするのは現実的ではありません。段階的なアプローチを推奨します。まず、完全一致(メールアドレスやドメインが完全に一致)のレコードをHubSpotのマージ機能や一括操作で処理します。次に、あいまい一致の候補を重複管理ツールで確認し、明確なものから順に処理していきます。数千件規模の場合、Data HubのカスタムコードやAPIを活用した半自動処理の検討も有効です。並行して、重複の発生防止策を導入し、新たな重複の発生を止めることが重要です。

A. 可能です。HubSpotの標準機能(重複管理ツール、ワークフロー、リスト機能、インポート機能)だけでも、基本的なデータクレンジングは十分に実行できます。Data Hubは、データ品質自動化やカスタムコードなどの高度な自動化を提供しますが、これらがなくても手動運用とワークフローの組み合わせでカバーできます。重要なのはツールの有無ではなく、運用ルールと運用サイクルの設計です。まずは標準機能でクレンジング運用を確立し、運用の中で自動化のニーズが明確になった段階でData Hubの導入を検討するアプローチが実践的です。

A. データクレンジングの効果を経営層に伝えるには、ビジネスインパクトの言語で説明することが重要です。具体的には、以下の観点が有効です。メール配信の到達率向上による「マーケティング施策の効果改善」、重複統合による「正確な顧客数・パイプライン金額の把握」、営業が正しい情報にアクセスすることによる「営業効率の向上」、そしてAI活用の前提条件としての「データ基盤整備」です。定量的な指標(重複率の削減、入力率の向上、バウンス率の低下)をビフォーアフターで示すことで、投資対効果を明確に伝えられます。

A. 名寄せの判断に迷うケースは必ず発生します。その際のルールを事前に定めておくことが重要です。推奨するアプローチとして、まず「判断基準の明文化」があります。例えば「会社名の一致度が80%以上、かつ電話番号の下4桁が一致する場合は同一企業と判断する」のように基準を定めます。次に「判断保留リスト」の作成です。自動判定で確定できないものは保留リストに入れ、定期的に人間が確認します。さらに「グループ企業の扱い」を事前に決めておくことも重要です。親会社と子会社を別レコードにするのか、同一企業として統合するのかは、ビジネスの管理単位に基づいて判断します。迷うケースを無理に統合するよりも、保留にして慎重に判断する方が安全です。誤ったマージは取り消しが難しいためです。

株式会社StartLinkは、事業推進に関わる「販売促進」「DXによる業務効率化(ERP/CRM/SFA/MAの導入)」などのご相談を受け付けております。 サービスのプランについてのご相談/お見積もり依頼や、ノウハウのお問い合わせについては、無料のお問い合わせページより、お気軽にご連絡くださいませ。

株式会社StartLink 代表取締役。累計150社以上のHubSpotプロジェクト支援実績を持ち、Claude CodeやHubSpotを軸にしたAI活用支援・経営基盤AXのコンサルティング事業を展開。

HubSpotのトップパートナー企業や大手人材グループにて、エンタープライズCRM戦略策定・AI戦略ディレクションを経験した後、StartLinkを創業。現在はCRM×AIエージェントによる経営管理支援を専門とする。