title: "責任あるAI(Responsible AI)とは?企業の倫理的AI実践ガイド"

slug: "hubspot-ai/ai-governance/responsible-ai-enterprise-guide"

metaDescription: "責任あるAI(Responsible AI)の概念と企業での実践方法を解説。公平性・透明性・説明可能性・プライバシーの4原則と、具体的なガバナンス体制の構築方法を紹介します。"

featuredImage: "https://www.start-link.jp/hubfs/blog-featured-images/ai.webp"

blogAuthorId: "166212808307"

contentGroupId: "166203508570"

keywords: ["責任あるAI", "Responsible AI", "AI 倫理"]

category: "BF_ai-governance"

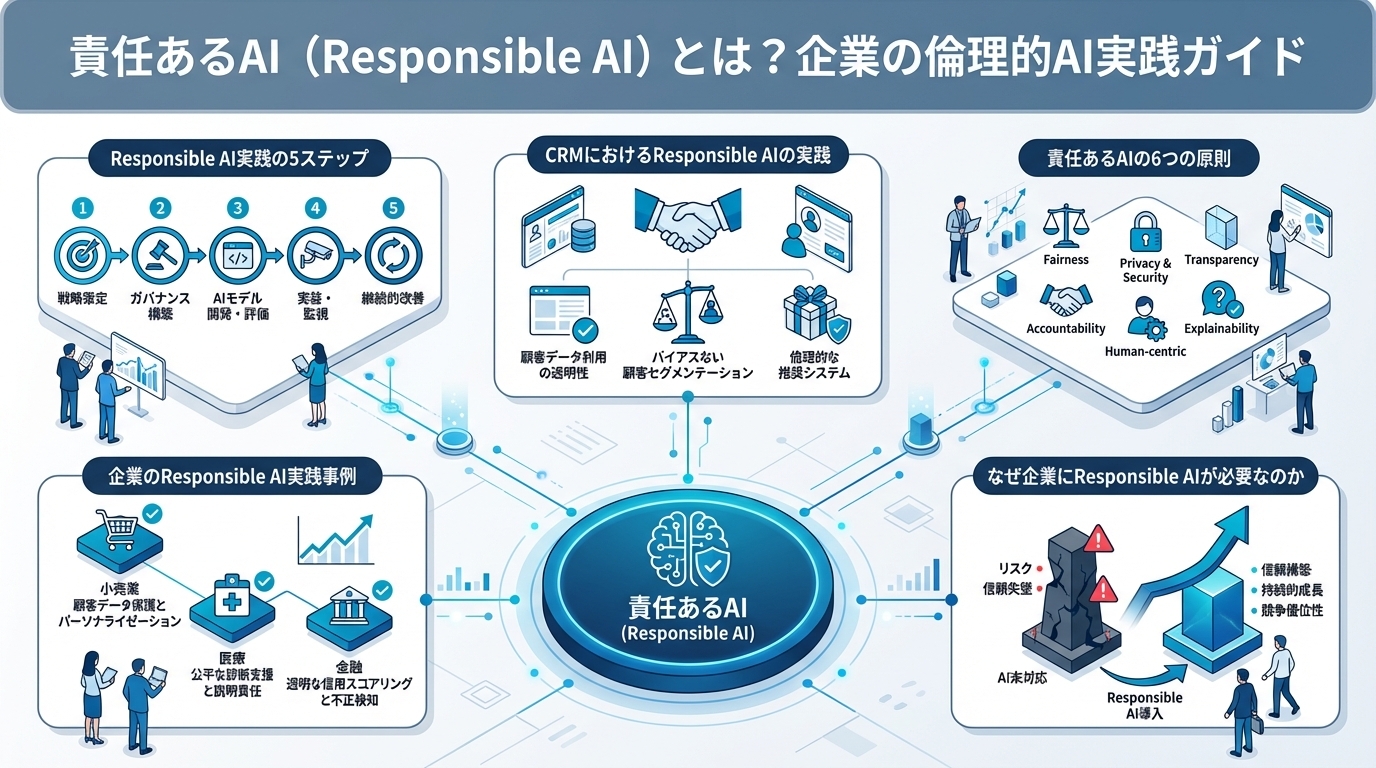

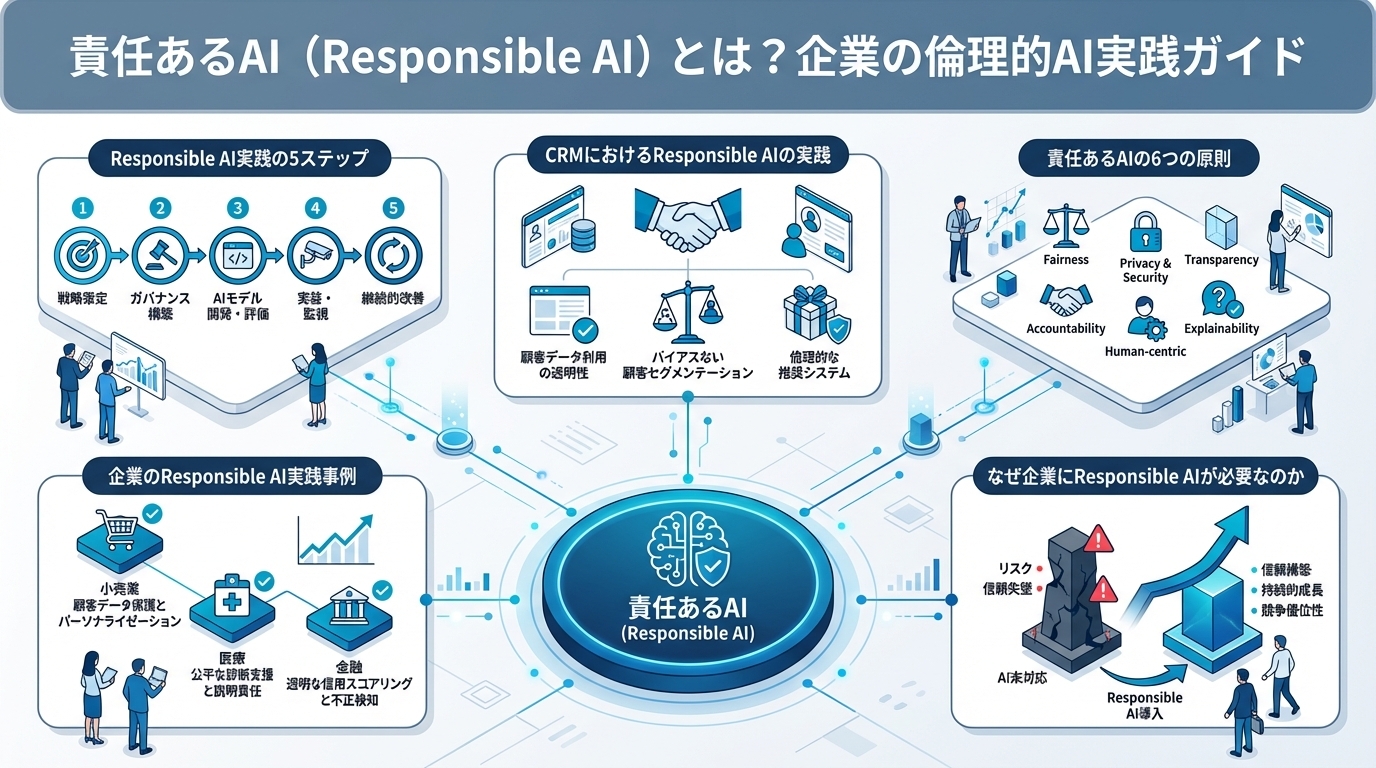

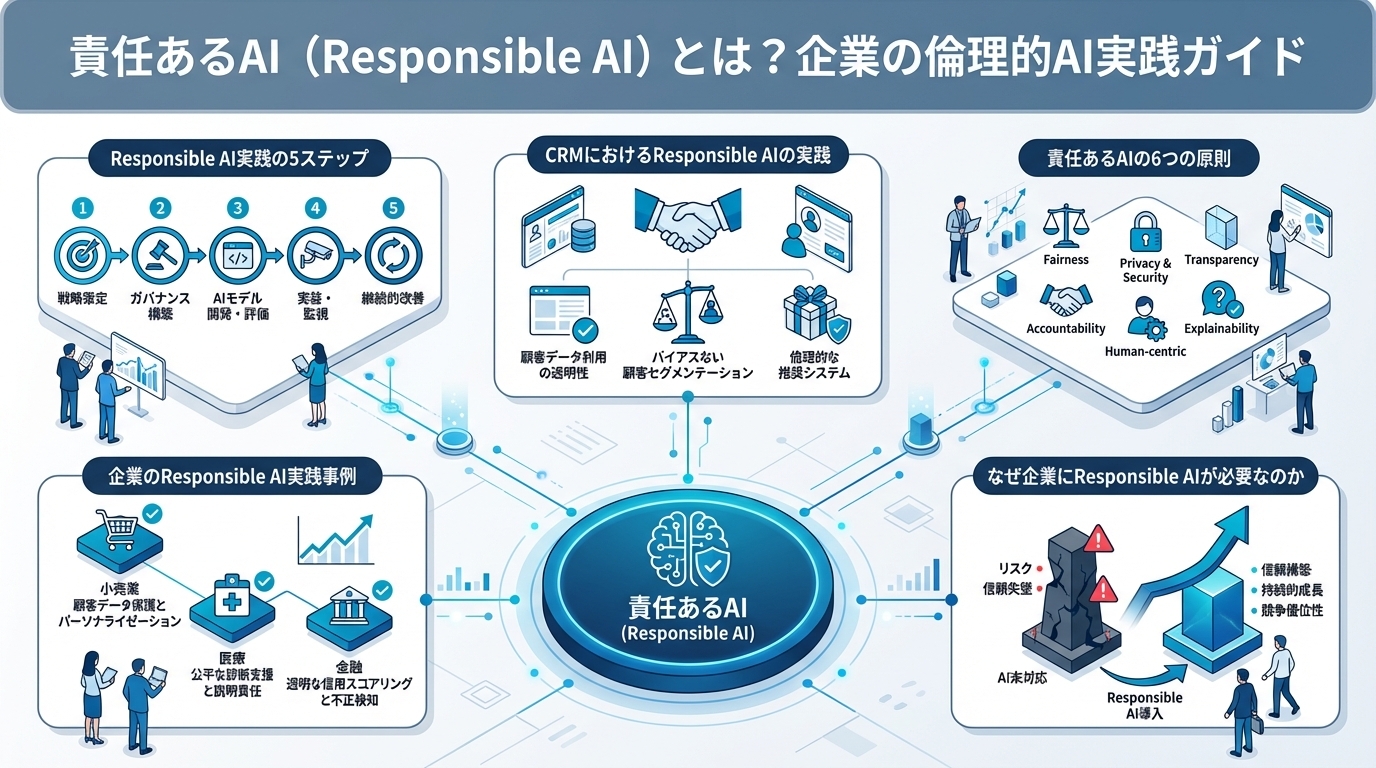

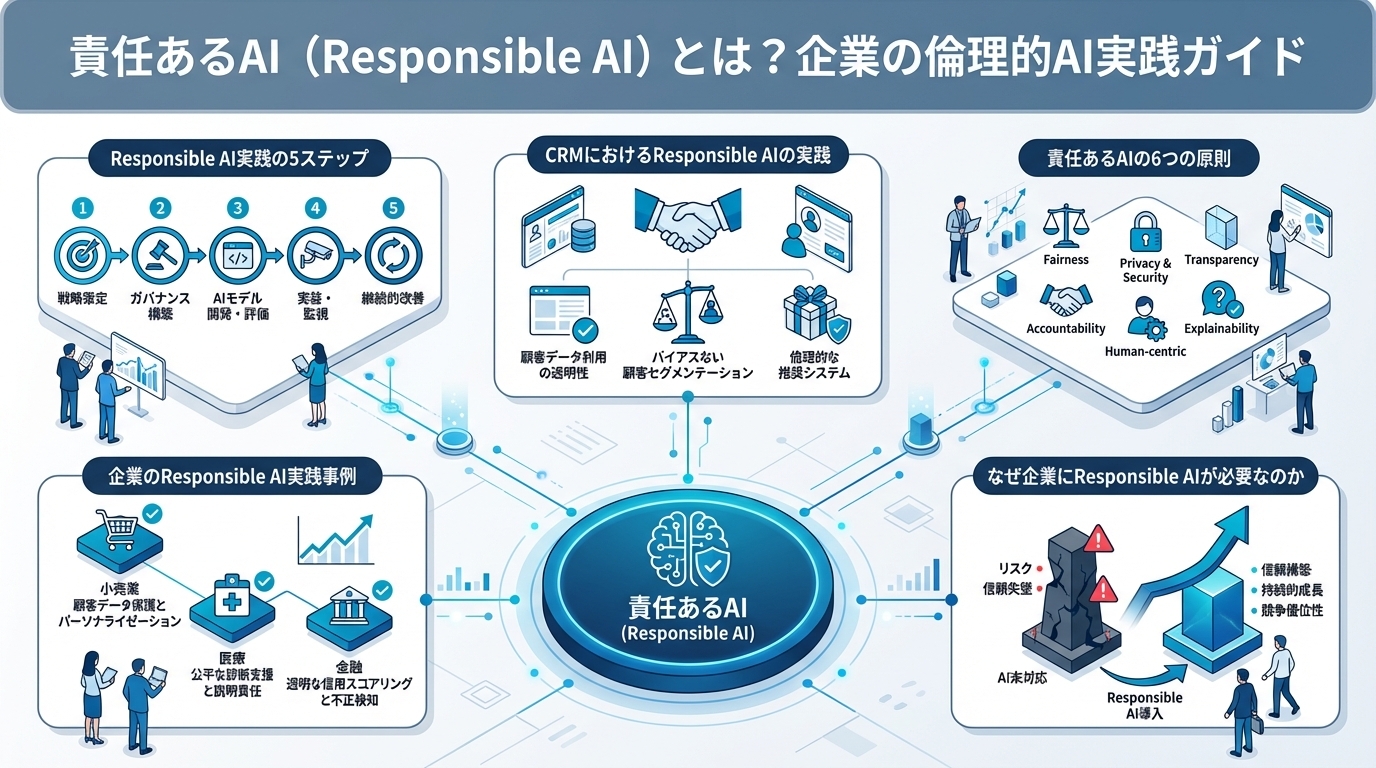

AIの活用が急速に広がる中、「AIの判断が公平か」「AIの仕組みが説明可能か」「AIがプライバシーを侵害していないか」――こうした倫理的な問いが企業に突きつけられています。

責任あるAI(Responsible AI)とは、公平性、透明性、説明可能性、プライバシー保護、安全性を備えたAIシステムを設計・開発・運用するための包括的なアプローチです。

責任あるAIの6つの原則

| 原則 |

内容 |

具体例 |

| 公平性(Fairness) |

AIが特定のグループに対して不公平な判断をしない |

採用AIが性別・人種でスコアに差を出さない |

| 透明性(Transparency) |

AIの利用状況と判断プロセスを開示する |

AIチャットボットであることを明示する |

| 説明可能性(Explainability) |

AIの判断根拠を人間が理解できる形で説明する |

リードスコアの算出根拠を表示する |

| プライバシー(Privacy) |

個人データの収集・利用・保護を適切に行う |

データ最小化の原則、同意管理 |

| 安全性(Safety) |

AIが意図しない害を与えないよう設計する |

ハルシネーション対策、ガードレール |

| 説明責任(Accountability) |

AIの判断結果に対する組織的な責任を明確にする |

AI倫理委員会の設置、監査体制 |

なぜ企業にResponsible AIが必要なのか

ビジネスリスクの軽減

AIの不適切な判断により、レピュテーションリスク、訴訟リスク、規制対応コストが発生する可能性があります。Responsible AIの実践は、これらのリスクを未然に防ぎます。

規制対応の準備

EU AI法、日本のAI推進法など、AI規制は世界的に強化される方向にあります。Responsible AIの体制を先行して構築しておくことで、将来の規制にスムーズに対応できます。

顧客・投資家からの信頼

ESG投資の観点からも、AI倫理への取り組みは企業価値に直結します。AI倫理原則を公開し、実践している企業は、顧客・投資家からの信頼を獲得しやすくなります。

企業のResponsible AI実践事例

Microsoft

Microsoftは、2018年にAI倫理原則を策定し、全社的なResponsible AI体制を構築。Office of Responsible AIを設置し、AIプロダクトの開発全体にわたる倫理審査プロセスを導入しています。具体的には、Responsible AI Standardとして200以上のチェック項目を定義し、AIプロダクトのリリース前に必ず評価を実施しています。

Google

Googleは、2018年に「AI Principles」を公表。兵器への応用や人権侵害につながるAI開発を禁止する原則を掲げています。社内にAI Ethics Councilを設置し、AIプロジェクトの倫理的影響を評価しています。

Salesforce

Salesforceは、「Trusted AI」の原則のもと、CRM内のAI機能(Einstein)に対して、バイアス検出、説明可能性、データ保護のメカニズムを組み込んでいます。AIが生成したスコアリングの根拠を可視化する機能により、ブラックボックス化を防いでいます。

NEC

NECは、「AIと人権に関するポリシー」を策定。顔認証技術などの社会的影響の大きいAIに対して、外部有識者を交えた倫理審査を実施しています。

Responsible AI実践の5ステップ

ステップ1:AI倫理原則の策定

自社のAI利用に適用する倫理原則を策定し、公開します。既存のフレームワーク(OECD AI原則、広島AIプロセス)を参考に、自社の事業特性に合わせた原則を定義します。

ステップ2:ガバナンス体制の構築

| 体制 |

役割 |

| AI倫理委員会 |

AI倫理に関する最高意思決定機関 |

| AI推進責任者 |

日常的なAI管理の責任者 |

| 倫理審査プロセス |

AI導入時のリスク評価・承認プロセス |

| 外部アドバイザー |

学識者・弁護士等による第三者的な助言 |

ステップ3:バイアス検出・公平性評価

AIモデルの出力を属性(性別、年齢、地域等)ごとに分析し、偏りがないかを検証します。

ステップ4:説明可能性の確保

AIの判断根拠をユーザーや監査担当者に説明できる仕組みを構築します。SHAP値やLIMEなどの説明可能AI技術の活用も検討します。

ステップ5:継続的なモニタリング

AIの運用中に公平性やパフォーマンスが劣化していないかを継続的に監視します。ドリフト検知の仕組みを導入し、定期的なモデル再評価を実施します。

CRMにおけるResponsible AIの実践

CRMのAI機能(リードスコアリング、予測分析、レコメンデーション)は、営業・マーケティングの意思決定に直接影響します。スコアリングのロジックが透明で説明可能であること、特定の業界や企業規模にバイアスがかかっていないこと、顧客データのプライバシーが保護されていることを確認し、Responsible AIの原則をCRM運用に組み込むことが重要です。