title: "生成AIの情報漏洩リスクと対策|安全な業務利用のためのセキュリティガイド"

slug: "hubspot-ai/ai-governance/ai-data-security-guide"

metaDescription: "生成AIの情報漏洩リスクと企業が取るべきセキュリティ対策を解説。法人プランの選び方、DLP連携、データ分類ルール、安全な業務利用体制の構築方法を紹介します。"

featuredImage: "https://www.start-link.jp/hubfs/blog-featured-images/ai.webp"

blogAuthorId: "166212808307"

contentGroupId: "166203508570"

keywords: ["AI 情報漏洩", "生成AI セキュリティ", "AI データ保護"]

category: "BF_ai-governance"

生成AIの業務活用が広がるにつれ、情報漏洩リスクへの懸念も高まっています。IPA(情報処理推進機構)の2024年調査では、企業のIT部門の68%が「生成AIからの情報漏洩」を最大のセキュリティ懸念として挙げています。

本記事では、生成AIの情報漏洩リスクの実態と、企業が講じるべき具体的なセキュリティ対策を解説します。

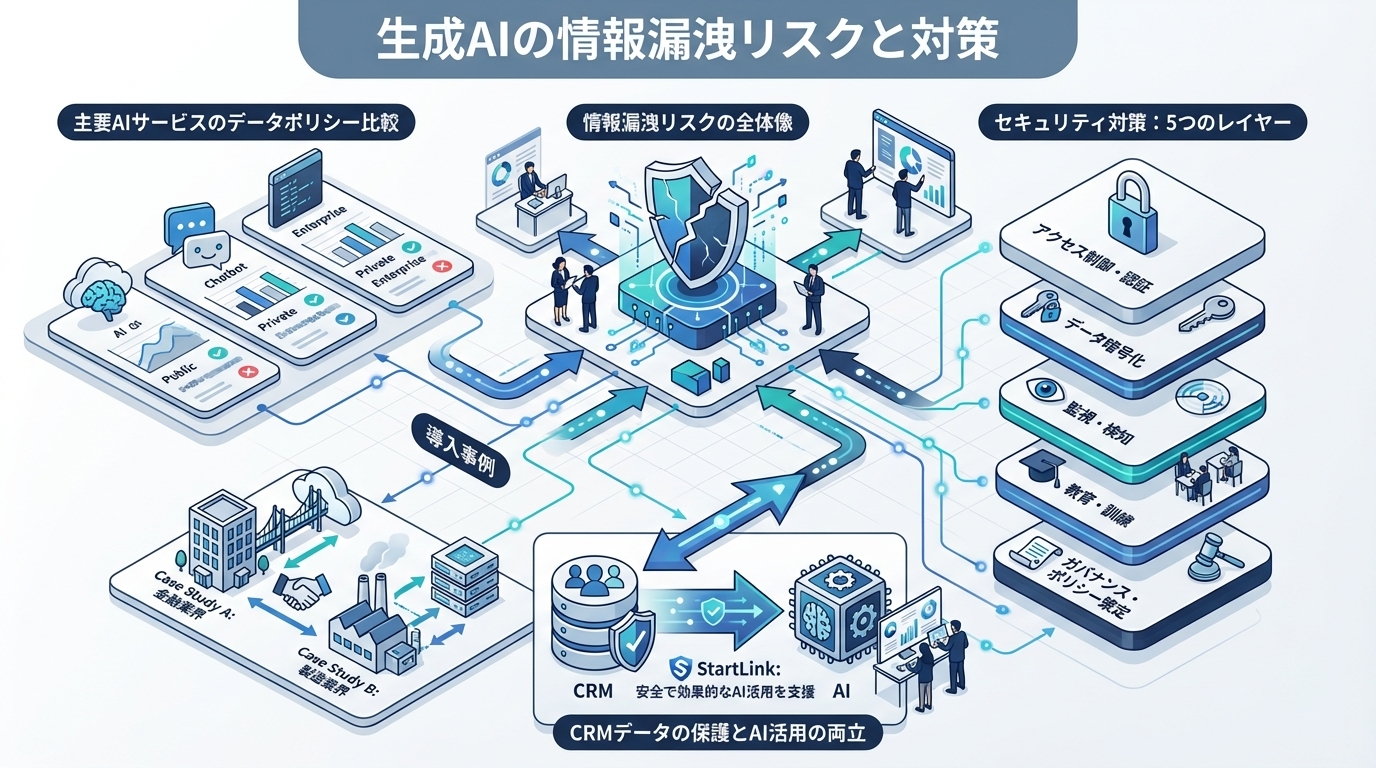

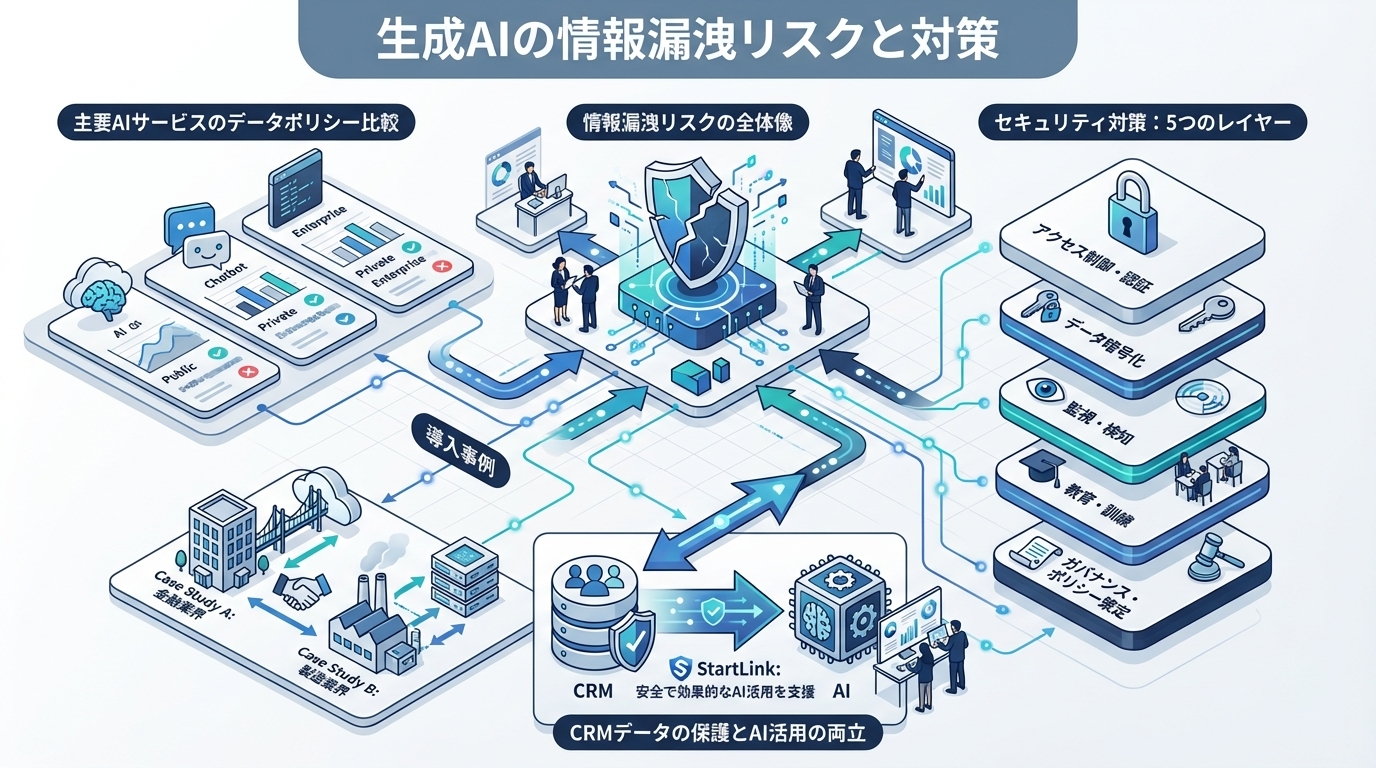

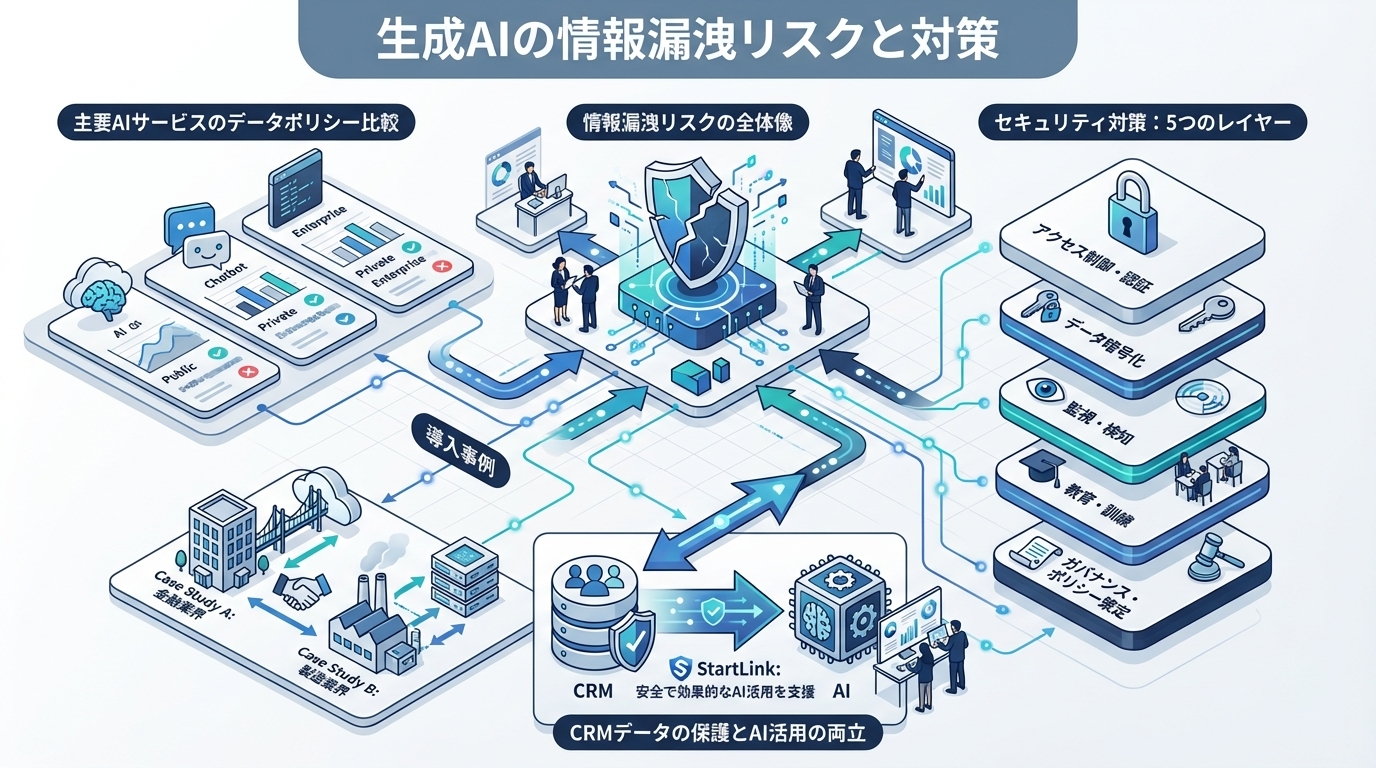

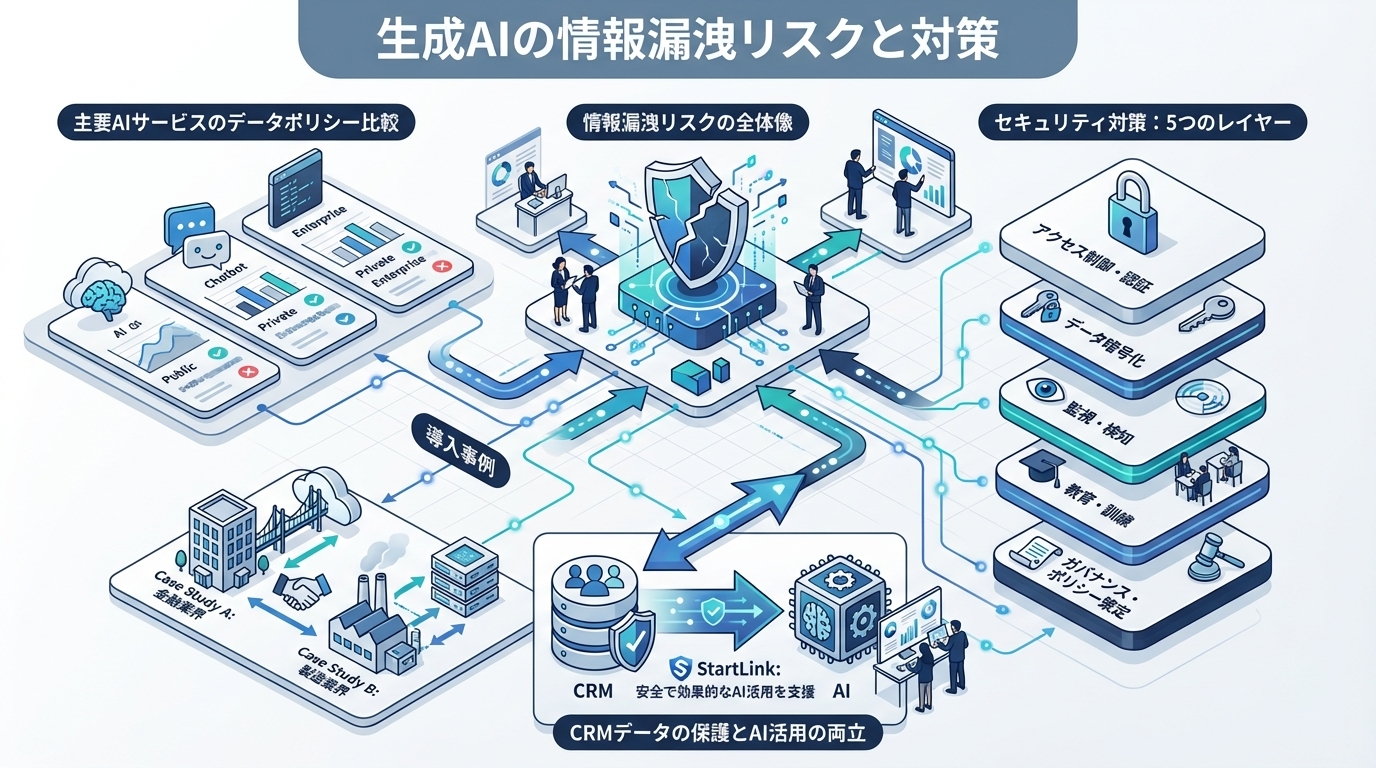

情報漏洩リスクの全体像

生成AIに関連する情報漏洩リスクは、主に3つの経路で発生します。

| 経路 |

リスク内容 |

具体例 |

| 入力経路 |

機密情報がAIサービスのサーバーに送信される |

ソースコード、顧客リスト、契約書の内容を入力 |

| 学習経路 |

入力データがAIの学習に使用され、他者の回答に反映 |

無料プランで入力した情報がモデル改善に利用 |

| 出力経路 |

AIの回答から他者が入力した情報が推測・復元される |

プロンプトインジェクション攻撃による情報抽出 |

主要AIサービスのデータポリシー比較

| サービス |

無料プランの学習利用 |

法人プランの学習利用 |

データ保持期間 |

SOC2認証 |

| ChatGPT |

オプトアウト可能 |

学習に使用しない |

30日 |

取得済み |

| Claude |

オプトアウト可能 |

学習に使用しない |

30日 |

取得済み |

| Gemini |

利用される場合あり |

学習に使用しない |

設定可能 |

取得済み |

| Copilot(M365) |

学習に使用しない |

学習に使用しない |

テナント内保持 |

取得済み |

セキュリティ対策:5つのレイヤー

レイヤー1:アクセス管理

| 対策 |

内容 |

| 法人プランの一元管理 |

個人アカウントの利用を禁止し、法人プランで全社員のアクセスを管理 |

| SSO/SAML連携 |

社内IDプロバイダとの連携で認証を一元化 |

| ロールベース権限 |

部門・役職に応じたAI利用権限の設定 |

| 利用ログの取得 |

誰が・いつ・何を入力したかのログを記録 |

レイヤー2:データ分類と入力制御

社内データを機密レベルで分類し、AIへの入力可否を明確にします。

| 機密レベル |

データ例 |

AI入力 |

| 極秘 |

未公開の財務情報、M&A情報、個人番号 |

禁止 |

| 機密 |

顧客リスト、契約書、ソースコード |

法人プラン+マスキング処理後に限定許可 |

| 社内限定 |

社内レポート、議事録、提案書ドラフト |

法人プランで利用可 |

| 公開可能 |

プレスリリース、公開ブログ、製品パンフレット |

制限なし |

レイヤー3:DLP(Data Loss Prevention)連携

DLPツールを導入し、AIサービスへの機密データ送信を自動的にブロックまたは警告します。

| DLPツール |

特徴 |

| Microsoft Purview |

Microsoft 365環境での統合DLP。Copilot連携 |

| Nightfall AI |

AI特化のDLP。ChatGPT/Slack/GitHub対応 |

| Netskope |

CASB+DLP。クラウドアプリのデータフロー制御 |

| Zscaler |

ゼロトラストベースのDLP。AI利用の可視化 |

レイヤー4:プライベートデプロイ

特に機密性の高いデータを扱う場合は、AIモデルを自社環境(VPC、オンプレミス)にデプロイする選択肢も検討します。

| デプロイ方式 |

特徴 |

コスト |

| Azure OpenAI Service |

Azureテナント内でGPT-4を利用。データは外部に出ない |

Azure利用料+API料金 |

| AWS Bedrock |

AWS VPC内でClaude/Titan等を利用 |

AWS利用料+API料金 |

| オンプレミスLLM |

Llama 3等のOSSモデルを自社サーバーで運用 |

GPU/サーバーコスト |

レイヤー5:教育と文化

技術的な対策だけでは限界があります。全社員への定期的なセキュリティ研修が不可欠です。

- 生成AIの仕組みとデータの流れの理解

- 入力してはいけないデータの具体例

- インシデント発生時の報告手順

- 実際のインシデント事例の共有

導入事例

三菱商事

三菱商事は、社内の生成AI利用にAzure OpenAI Serviceを採用。自社のAzureテナント内でGPT-4を運用し、データが外部に一切流出しない体制を構築。さらにDLPと連携し、機密レベルの高いデータの入力を自動ブロックする仕組みを導入しています。

リコー

リコーは、全社で約4万人が利用する生成AI環境を構築。AWS Bedrock上でClaudeを運用し、入力データのログ記録・監査体制を整備。部門ごとに利用可能なAI機能を制御し、セキュリティとユーザビリティを両立しています。

CRMデータの保護とAI活用の両立

CRMに蓄積された顧客データは企業の最も価値ある情報資産です。CRMデータをAIで活用する際は、CRMのアクセス権限設計に合わせてAIの参照範囲を制御し、個人情報のマスキング処理を適用するなど、データ保護とAI活用を両立させる設計が求められます。