ブログ目次

「CTAの色を変えたらコンバージョンが増えた」「ヘッドラインを変更したらCVRが下がった」——こうした施策の効果を正確に判定するために不可欠なのがA/Bテストです。感覚や経験則ではなく、データに基づいた意思決定こそが、Webマーケティングの成果を持続的に向上させる唯一の方法です。

しかし、A/Bテストを正しく実施できている企業は意外と少ないのが実情です。「サンプルサイズが不十分なまま結論を出す」「複数要素を同時に変更して何が効果的かわからない」「統計的有意差を無視して勝敗を判定する」といった誤りが頻発しています。不正確なテスト結果に基づく施策は、改善どころか悪化を招くリスクがあります。

本記事では、A/Bテストの基本概念から、仮説設計、テスト実施手順、統計的有意差の判断方法、主要ツール比較まで、A/Bテストに必要な知識を網羅的に解説します。初めてA/Bテストに取り組む方から、精度を高めたい中級者まで活用できる内容です。

この記事でわかること

- A/Bテストの基本概念と他のテスト手法との違い

- テスト効果を最大化する仮説設計のフレームワーク

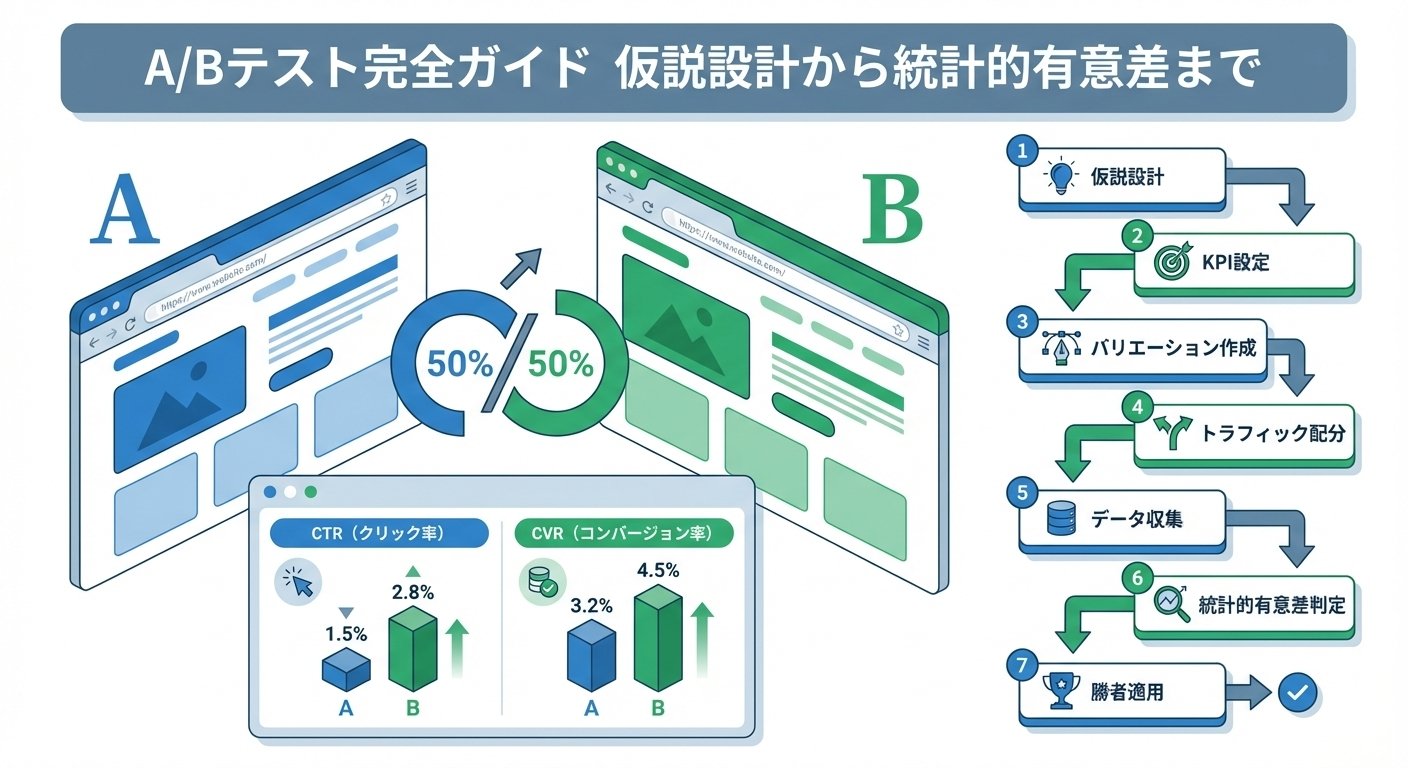

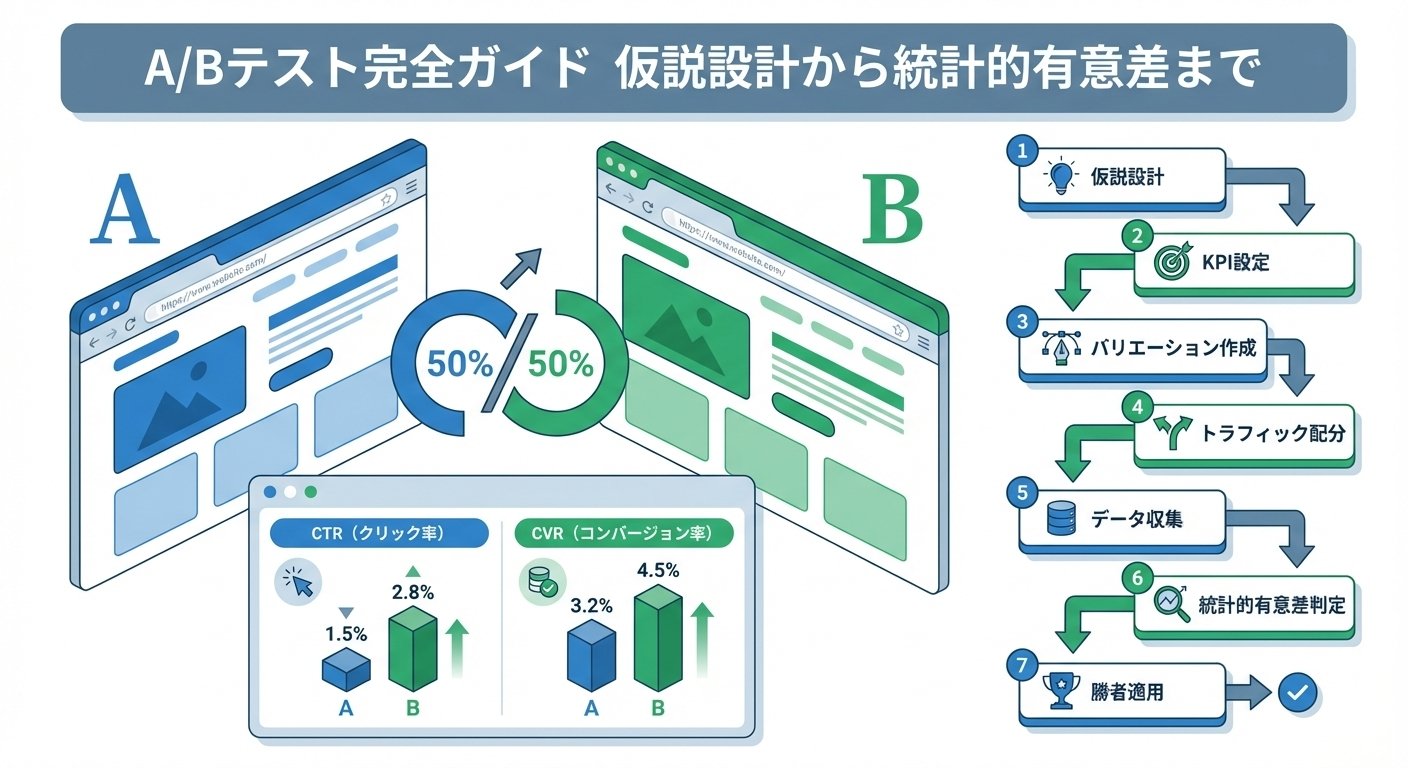

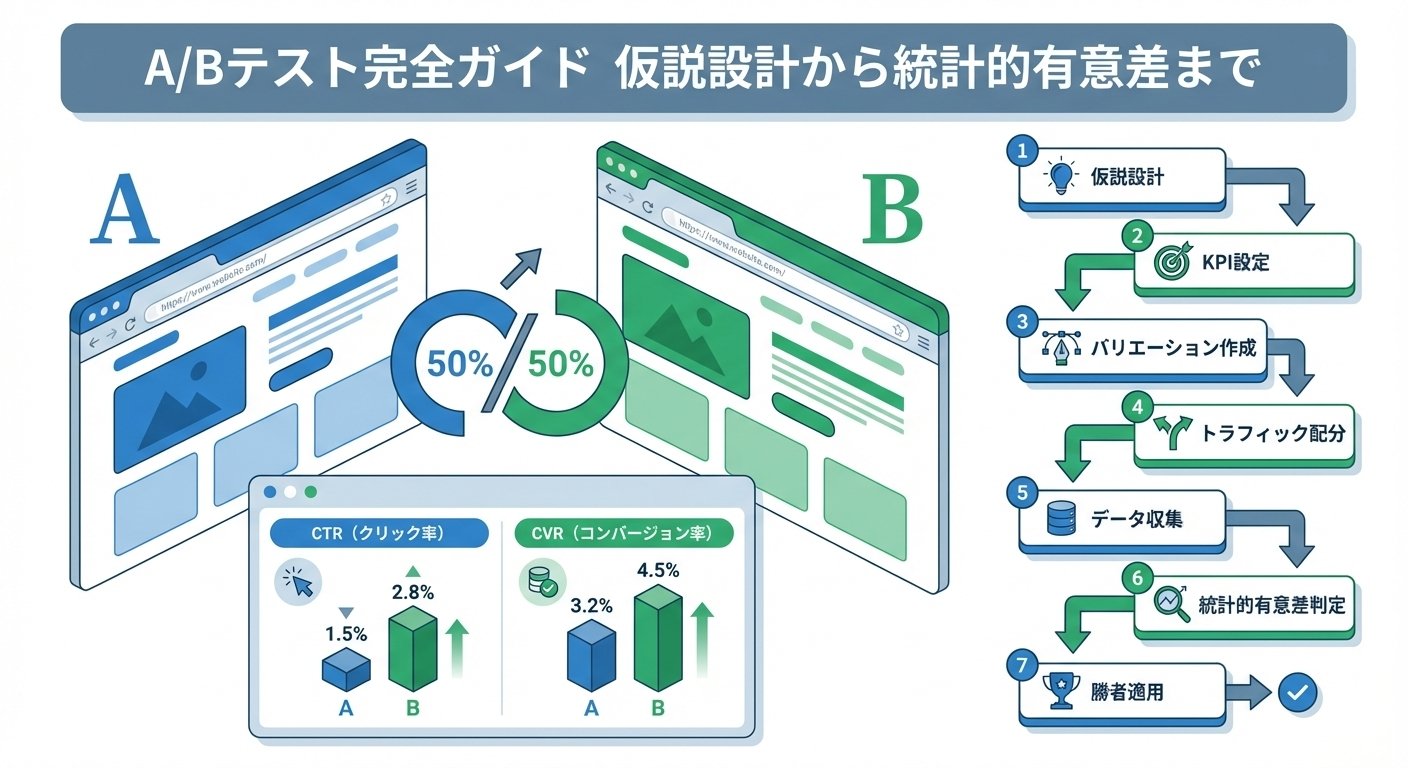

- A/Bテストの具体的な実施手順(7ステップ)

- 統計的有意差の判断方法と最低サンプルサイズの計算

- 主要A/Bテストツール7選の機能・価格比較

- よくある失敗パターンとその回避策

A/Bテストの基本知識

A/Bテストとは

A/Bテスト(スプリットテスト)とは、Webページやメールなどの要素について、2つ以上のバリエーションを作成し、ランダムに振り分けたユーザーグループに表示して、どちらがより高い成果を生むかを統計的に検証する手法です。

A/Bテストと他のテスト手法の比較

| テスト手法 | 変更要素数 | 必要トラフィック | 複雑度 | 適した場面 |

|---|---|---|---|---|

| A/Bテスト | 1要素 | 中 | 低 | CTA文言、色、画像の変更 |

| 多変量テスト | 複数要素 | 大 | 高 | 複数要素の最適な組み合わせ |

| リダイレクトテスト | ページ全体 | 中 | 中 | LP全体のリニューアル検証 |

| バンディットテスト | 1要素 | 少 | 中 | リアルタイム最適化 |

A/Bテストで検証できる要素

| カテゴリ | テスト対象 | 期待改善幅 |

|---|---|---|

| コピー | ヘッドライン、サブコピー、本文 | 10〜50% |

| CTA | 文言、色、サイズ、配置 | 10〜40% |

| フォーム | 項目数、レイアウト、入力方式 | 20〜60% |

| ビジュアル | メイン画像、動画、アイコン | 5〜25% |

| レイアウト | セクション順序、カラム構成 | 10〜30% |

| 社会的証明 | 事例の種類、配置場所 | 10〜25% |

仮説設計のフレームワーク

なぜ仮説が重要か

仮説なしのA/Bテストは、ただの「当てずっぽう」です。仮説を立てることで、テストの目的が明確になり、結果から得られる学びが格段に深くなります。

仮説設計の3ステップ

ステップ1:データから課題を特定する

| データソース | 確認ポイント | 課題の例 |

|---|---|---|

| GA4 | 直帰率・離脱率 | ファーストビューで70%が離脱 |

| ヒートマップ | クリック・スクロール | CTAが視認されていない |

| フォーム分析 | 項目別離脱率 | 電話番号項目で40%が離脱 |

| ユーザーテスト | 行動観察 | 価格情報が見つからず離脱 |

ステップ2:仮説を構造化する

仮説は以下のフォーマットで記述します。

【観察】:現状の課題を客観的に記述

【変更】:具体的な変更内容を記述

【予測】:変更によって期待される効果を数値で記述

【根拠】:なぜその効果が期待できるかの理由仮説の記述例:

【観察】:問い合わせフォームの離脱率が75%と高い

【変更】:フォーム項目を10項目から5項目に削減する

【予測】:フォーム完了率が25%から40%に向上する(+60%)

【根拠】:業界調査により項目数50%削減でCVR30〜60%向上のデータありステップ3:テスト優先順位を決める

ICEスコアリングで優先順位を決定します。

| 仮説 | Impact(1-10) | Confidence(1-10) | Ease(1-10) | ICEスコア |

|---|---|---|---|---|

| CTA文言変更 | 7 | 8 | 9 | 504 |

| フォーム項目削減 | 9 | 7 | 6 | 378 |

| ヘッドライン変更 | 8 | 6 | 8 | 384 |

| ページ構成変更 | 8 | 5 | 4 | 160 |

A/Bテストの実施手順(7ステップ)

ステップ1:テスト対象と目標KPIを決める

| 項目 | 内容 |

|---|---|

| テスト対象ページ | 問い合わせLP |

| テスト要素 | CTAボタンの文言 |

| 目標KPI | CTAクリック率 |

| 現在の値 | 2.1% |

| 目標改善幅 | +30%以上(2.7%以上) |

ステップ2:バリエーションを作成する

1回のテストで変更するのは1要素だけ。 これがA/Bテストの鉄則です。

| パターン | 内容 |

|---|---|

| A(コントロール) | 現状のまま:「お問い合わせ」 |

| B(バリエーション) | 変更案:「専門家に無料で相談する」 |

ステップ3:サンプルサイズを計算する

統計的に信頼できる結果を得るために、必要なサンプルサイズを事前に計算します。

サンプルサイズの計算に必要な3つのパラメータ:

| パラメータ | 説明 | 推奨値 |

|---|---|---|

| 現在のCVR(ベースライン) | テスト前のコンバージョン率 | 実測値 |

| 最小検出可能効果(MDE) | 検出したい最小の改善幅 | 10〜20% |

| 統計的有意水準 | 偽陽性のリスク許容度 | 95%(α=0.05) |

| 検出力 | 偽陰性のリスク許容度 | 80%(β=0.20) |

CVR別の必要サンプルサイズ目安(MDE=20%の場合):

| ベースラインCVR | 各パターンの必要サンプル数 | 合計必要サンプル数 |

|---|---|---|

| 1% | 約38,000 | 約76,000 |

| 2% | 約19,000 | 約38,000 |

| 5% | 約7,500 | 約15,000 |

| 10% | 約3,600 | 約7,200 |

ステップ4:テストを実施する

- トラフィックを50:50でランダムに振り分ける

- テスト期間中は対象ページの他の変更を行わない

- 外部要因(キャンペーン、季節変動)の影響を記録する

ステップ5:テスト期間の目安

| 条件 | 推奨テスト期間 |

|---|---|

| 最低期間 | 2週間(曜日変動の平均化) |

| 推奨期間 | 3〜4週間 |

| 最長期間 | 6週間(これを超えたら条件を見直す) |

ステップ6:統計的有意差を判断する

テスト終了後、以下の基準で結果を判定します。

| 判定基準 | 値 | 意味 |

|---|---|---|

| p値 | < 0.05 | 95%の確率で差が偶然でない |

| 信頼区間 | 0をまたがない | 改善効果がある |

| 必要サンプル数 | 達成済み | 十分なデータがある |

ステップ7:結果を実装し、次のテストへ

- 勝ちパターンを本番環境に反映する

- テスト結果をドキュメント化する

- 次のテスト仮説を立てる

主要A/Bテストツール比較

ツール比較一覧

| ツール名 | 月額費用 | 特徴 | 対象企業規模 |

|---|---|---|---|

| Google Optimize後継(GA4連携) | 無料〜 | GA4とのネイティブ連携 | 小〜中 |

| HubSpot Marketing Hub | ¥96,000〜 | CRM連携、LP・メール一体型 | 中〜大 |

| Optimizely | 要問合せ | エンタープライズ向け、高度な統計 | 大 |

| VWO | $199〜 | 直感的なUI、ヒートマップ付き | 小〜中 |

| AB Tasty | 要問合せ | AIレコメンド機能 | 中〜大 |

| KAIZEN PLATFORM | 要問合せ | 日本語対応、運用代行あり | 中〜大 |

| DLPO | ¥100,000〜 | 日本製、多変量テスト対応 | 中〜大 |

ツール選定のチェックリスト

- 自社のCMSやアナリティクスツールと連携できるか

- 必要なテスト種類(A/B、多変量、リダイレクト)に対応しているか

- 統計的有意差の自動判定機能があるか

- ビジュアルエディタでコーディング不要か

- 日本語サポートがあるか

- 月間PV数に対して料金が適切か

よくある失敗パターンと回避策

失敗パターン一覧

| 失敗パターン | 原因 | 回避策 |

|---|---|---|

| 早すぎる結論 | サンプル不足で判定 | 事前にサンプルサイズを計算 |

| 複数要素の同時変更 | 効果の切り分け不能 | 1テスト1要素を徹底 |

| テスト中の追加変更 | 条件の汚染 | テスト期間中は他の変更を凍結 |

| ピーキング問題 | テスト途中で結果を見て中止 | 事前に終了条件を決める |

| HiPPO問題 | 上司の意見で結果を覆す | データで判断する文化の醸成 |

| 勝者なしの放置 | 有意差がない場合の対応不明 | 新しい仮説を立ててリテスト |

テスト結果の解釈で注意すべきこと

- セグメント分析を行う:全体では有意差がなくても、特定のセグメント(デバイス別、流入元別)では差がある場合がある

- 二次指標も確認する:CVRだけでなく、直帰率、滞在時間、ページ/セッションなども確認

- 季節変動を考慮する:BtoBでは年度末(3月)や長期休暇前後で行動パターンが変わる

- 外部要因を記録する:テスト期間中のキャンペーン、メディア掲載、競合の動きなどを記録

A/Bテストの運用体制

テスト計画のテンプレート

| 項目 | 内容 |

|---|---|

| テスト名 | LP_CTA文言テスト_2026Q1 |

| テスト担当者 | マーケティング部 田中 |

| 仮説 | CTA文言変更でクリック率+30% |

| テスト対象 | 問い合わせLP |

| パターンA | 「お問い合わせ」(現状) |

| パターンB | 「専門家に無料で相談する」 |

| 目標KPI | CTAクリック率 |

| 必要サンプル数 | 各パターン5,000 |

| テスト期間 | 3/1〜3/14(2週間) |

| 判定基準 | p < 0.05 |

テスト頻度の目安

| 企業規模(月間PV) | 推奨テスト頻度 | 年間テスト数 |

|---|---|---|

| 〜50,000 PV | 月1回 | 12回 |

| 50,000〜200,000 PV | 月2回 | 24回 |

| 200,000 PV以上 | 月3〜4回 | 36〜48回 |

まとめ

A/Bテストは、Webマーケティングにおけるデータドリブンな意思決定の基盤です。感覚や経験則ではなく、統計的に検証された施策を積み重ねることで、持続的なCVR改善が実現できます。

本記事のポイントを整理します。

- 仮説ファースト:データから課題を特定し、構造化された仮説を立てる

- 1テスト1要素:変更要素を絞り、因果関係を明確にする

- 統計的判定:十分なサンプルサイズと有意水準で結論を出す

- 継続的なサイクル:テスト→学習→次のテストのループを回し続ける

HubSpotのMarketing Hubでは、LP、メール、CTAのA/Bテスト機能が標準搭載されています。テストの設計から実施、結果分析まで一つのプラットフォームで完結できます。A/Bテストの導入や運用にお悩みの方は、StartLinkにご相談ください。テスト戦略の策定から実務支援まで対応いたします。

この記事は2026年3月時点の情報に基づいて作成しています。

HubSpot導入のご相談

StartLinkでは、150社以上の支援実績をもとに、HubSpotの導入設計から運用定着まで一貫してサポートしています。CRM・SFA・MAの活用にお悩みの方は、お気軽に無料相談をご利用ください。

株式会社StartLinkは、事業を推進するためのHubSpot導入、また生成AIの社内業務への反映などのHubSpot×AI活用のご相談を受け付けております。 最近では、HubSpotを外部から操作するAIエージェント活用や、HubSpot内で使えるAI機能などのご相談をいただくことも増えてきており、サービスのプランについてご相談/お見積もり依頼があればお気軽にお問い合わせくださいませ。 無料のお問い合わせページより、お気軽にご連絡いただけます。

その他、HubSpot の設計の考え方や構築方法などをご紹介した YouTube チャンネルも運営しておりますので、社内の HubSpot 研修や HubSpot をこれから導入され、導入を検討されている企業様は、ぜひ一度ご確認いただいて、イメージをつかんでいただければなと思います。 すべて無料で公開しておりますので、こちらのYoutubeチャンネルを、ぜひチェックしてみてください!

関連キーワード:

サービス資料を無料DL

著者情報

今枝 拓海 / Takumi Imaeda

株式会社StartLinkの代表取締役。

HubSpotのトップパートナーである株式会社H&Kにて、HubSpotのCRM戦略/設計/構築を軸として、 国内・外資系エンタープライズ企業へコンサルティング支援を実施。

パーソルホールティングス株式会社にて、大規模CRM/SFA戦略の策定・PERSOLグループ横断のグループAI戦略/企画/開発ディレクションの業務を遂行経験あり。

株式会社StartLinkでは、累計100社以上のHubSpotプロジェクト実績を元にHubSpot×AIを軸にした経営基盤DXのコンサルティング事業を展開。